3. Установка Компонента

Примечание

Установка витрины данных производится без необходимости доступа к сети Интернет.

3.1. Установка Компонента «Витрина данных» конфигурации Стандарт

3.1.1. Порядок установки

Проверить соответствие серверов техническим характеристикам (см. раздел Рекомендуемые технические и программные средства).

Выполнить предварительные действия перед установкой Компонента (см. раздел Предварительные действия).

Установить на серверы, в соответствующем порядке, следующее программное обеспечение:

Prostore (dtm-query-execution-core);

СМЭВ QL Сервер;

СМЭВ3-адаптер;

BLOB-адаптер;

Сервис формирования документов;

Стандартный загрузчик;

ETL;

CSV-Uploader;

DATA-Uploader;

REST-Uploader;

Сервис генерации уникального номера (Counter-Provider);

Агент проверок.

Проверить работу всех модулей Компонента (см. раздел Проверка Компонента).

Версии модулей Компонента приведены в Состав модулей в дистрибутиве документа «Техническое описание Компонента «Витрина данных»».

Описание настроек модулей приведено в документе «Руководство администратора Компонента «Витрина данных».

3.1.2. Установка Prostore (dtm-query-execution-core)

Установка Prostore должна осуществляться после установки СУБД.

Prostore поставляется в виде дистрибутива с модулями в jar-файлах (dtm-query-execution-core).

Процесс установки состоит из следующих действий приведен в разделе Сборка и развертывание документации Prostore.

Примечание

Перед установкой Prostore необходимо сверить версию модуля, включенного в дистрибутив, (см. раздел Состав модулей в дистрибутиве в документе «Техническое описание Компонента «Витрина данных»») и открыть соответствующую версию документации Prostore для установки соответствующего окружения.

JDBC-driver (dtm-jdbc-driver) поставляется совместно с Prostore в релизе Компонента «Витрина данных.

Для переноса системных данных (сервисной БД) из ZooKeeper в Postgres-совместимые СУБД при обновлении кластера Prostore используется команда ZK2PG утилиты DTM Tools.

3.1.3. Установка СМЭВ QL Сервера

3.1.3.1. Процесс установки

Действия по установке выполняются через SSH консоль технологического пользователя.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить модуль (Описание процесса запуска приведено в разделе Быстрый старт Руководства администратора Компонента «Витрина данных»).

Проверить работу модуля.

3.1.3.1.1. Предусловия выполнения первого запуска новой версии SMEVQL

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Проверить версию Prostore (для работы новой версии SMEVQL (с хранением данных персистентности в Prostore) требуется Prostore версии 7.6 и выше).

Проверить тип подключенных датасорсов Prostore (в Prostore данные персистентности хранятся в snapshot-таблицах, которые поддерживаются только типом ADP):

если все имеющиеся датасорсы с типом ADP, перейти к следующему шагу;

если нет ни одного ADP-датасорса, то необходимо развернуть СУБД PostgreSQL и настроить подключение к Prostore (при отсутствии ADP использование новой версии SMEVQL невозможно);

если имеются и ADP, и датасорсы других типов, необходимо в конфигурационном файле SMEVQL задать перечень наименований ADP-датасорсов, используемых для обеспечения персистентности;

Для обновления выбрать период минимальной прикладной активности (асинхронные ответы при обновлении витрины не сохраняются).

Остановить изменения в витрине - отключить доступ клиентов к загрузчикам /выключить загрузчики данных, чтобы остановить формирование новых пуш-уведомлений.

Проверить состав очередей пуш-уведомлений в таблице

smevqlqueue.reestr_queue:

по имеющимся записям проверить отсутствие записей в таблицах

queue_$agent_target_$resource;дождаться пока очереди будут пустые (очереди пуш-уведомлений при обновлении не сохраняются).

Остановить SMEVQL.

(опционально) в конфигурации новой версии SMEVQL задать настройки подключения к Postgres для выполнения миграции данных таблицы

push_consumers.Запустить новую версию SMEVQL в одном экземпляре. В случае запуска в нескольких экземпляров возможны ошибки при выполнении миграции.

После успешного выполнения миграции (модуль запущен, в логах отсутствуют ошибки миграции) выполнить запуск других экземпляров при необходимости.

В случае наличия в логах ошибок миграции, необходимо устранить возможные причины и повторить запуск одного экземпляра SMEVQL новой версии.

3.1.3.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файлов:

application.yaml- конфигурирует поведение сервера;credentials.yaml- конфигурирует представление сервера.

Пример файлов конфигурации и возможные настройки модуля приведены в разделе Конфигурирование сервера Руководства администратора.

3.1.3.1.3. Загрузка JAR-файла на сервер

Для загрузки файла на сервер выполните команду:

scp file.jar user_name@IP:/home/dir

где,

file.jar- название JAR-файла;user_name- имя пользователя, например,sudoилиroot;IP- адрес сервера;/home/dir- директория на сервере, в которую будет загружен файл.

3.1.4. Установка СМЭВ3-адаптера

3.1.4.1. Установка модуля

Действия по установке выполняются через SSH консоль технологического пользователя.

3.1.4.1.1. Установка КриптоПро

Установка СМЭВ3-адаптера возможна, только если были добавлены ключи (контейнер закрытого ключа) для сервиса «КриптоПро».

В случае использования для электронной подписи сервиса «КриптоПро», необходимо предварительно выполнить шаги:

скачать «КриптоПро JCP» (https://www.cryptopro.ru/download?pid=129) для Java JRE на сервер, где будет установлен СМЭВ3–адаптер;

установить загруженное ПО, следуя инструкции и документации на официальном сайте;

получить сертификат для установки от уполномоченных лиц и установить его в «КриптоПро».

3.1.4.2. Процесс установки

Модуль СМЭВ3-адаптер поставляется в виде JAR-файла. В поставку также входят следующие файлы:

файл настроек конфигурации модуля СМЭВ3-адаптер

application.yml;

сконфигурированные pebble-шаблоны.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить JAR-файл модуля (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.4.2.1. Предусловия выполнения первого запуска новой версии модуля

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Для исключения возникновения ошибок миграции, перед первым запуском новой версии компонентов модуля необходимо выполнить следующие действия:

Проверить версию Prostore (Для работы новой версии СМЭВ3-адаптера (с хранением данных персистентности в Prostore) требуется Prostore версии 7.6 и выше).

Проверить тип подключенных датасорсов Prostore (В Prostore данные персистентности хранятся в snapshot-таблицах, которые поддерживаются только в датасорсах с типом ADP):

если все имеющиеся датасорсы с типом ADP, перейти к следующему шагу;

если нет ни одного ADP-датасорса, то необходимо развернуть СУБД PostgreSQL и настроить подключение к Prostore (при отсутствии ADP использование новой версии СМЭВ3-адаптера с персистентностью в Prostore невозможно);

если имеются и ADP, и датасорсы других типов, необходимо в конфигурационном файле СМЭВ3-адаптера задать перечень наименований ADP датасорсов, используемых для обеспечения персистентности;

Опционально - включить выполнение миграции из Zookeeper (В конфигурационном файле нового СМЭВ3-адаптера задать настройки подключения к Zookeeper и установить флаг

MIGRATION_ZK_ENABLE:false).Для обновления выбрать период минимальной прикладной активности.

Остановить выгрузку изменений по расписанию.

Остановить СМЭВ3-адаптер.

Запустить новую версию СМЭВ3-адаптера в одном экземпляре (в случае запуска нескольких экземпляров возможны ошибки при выполнении миграции).

После успешного выполнения миграции (модуль запущен, в логах отсутствуют ошибки миграции) необходимо в конфигурации модуля отключить выполнение миграции из Zookeeper (если была включена) и выполнить запуск других экземпляров при необходимости.

В случае наличия в логах ошибок миграции, необходимо устранить возможные причины и повторить запуск одного экземпляра СМЭВ3-адаптера версии 2.6.0 и выше.

3.1.4.2.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в разделе Конфигурация СМЭВ3-адаптер (application.yml) Руководства администратора Компонента «Витрина данных».

3.1.4.2.3. Добавление папки для загрузки файлов модуля

Создайте на сервере папку, в которую будут загружены файлы модуля, например, /opt/smev3-adapter.

В случае если ранее была установлена старая версия СМЭВ3-адаптера, сделайте его резервную копию.

3.1.4.2.4. Загрузка файлов на сервер

Загрузите в созданную на предыдущем шаге папку:

JAR-файл модуля;

файл настроек конфигурации модуля СМЭВ3-адаптер (

application.yml);

сконфигурированные pebble-шаблоны.

3.1.4.2.5. Кластеризация модуля

Кластеризация модуля достигается путем запуска копии экземпляра данного модуля. Оптимальным вариантом является использование оркестраторов, например:

Kubernetes;

Openshift;

Docker-swarm;

Nomad.

3.1.5. Установка BLOB-адаптера

3.1.5.1. Установка модуля

Модуль BLOB-адаптер поставляется в виде jar-файла.

Общий процесс установки состоит из следующих действий:

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить jar-файл модуля (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.5.1.1. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены Конфигурация BLOB-адаптера (application.yml) Руководства администратора Компонента «Витрина данных».

3.1.5.1.2. Добавление папки для загрузки файлов модуля

Создайте на сервере папку, в которую будут загружены файлы модуля, например, /opt/blob-adapter.

В случае, если ранее была установлена старая версия модуля BLOB-адаптер, сделайте его резервную копию.

3.1.5.1.3. Загрузка файлов на сервер

Загрузите в созданную на предыдущем шаге папку:

jar-файл модуля;

файл настроек конфигурации модуля BLOB-адаптер (

application.yml).

3.1.6. Установка сервиса формирования документов

3.1.6.1. Установки модуля

Действия по установке выполняются через SSH консоль технологического пользователя.

3.1.6.1.1. Установка модуля

Модуль «Сервис формирования документов» поставляется в виде JAR-файла.

В поставку также входят следующие файлы:

файл настроек конфигурации модуля (

application.yml);

Общий процесс установки состоит из следующих действий:

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить JAR-файл модуля (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.6.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в разделе

Конфигурация модуля «Сервиса Формирования документов» (application.yml) Руководства администратора Компонента «Витрина данных».

3.1.6.1.3. Добавление папки для загрузки файлов модуля

Создайте на сервере папку, в которую будут загружены файлы модуля, например, /opt/printable-form-service.

В случае, если ранее была установлена старая версия Сервиса формирования документов, сделайте его резервную копию.

3.1.6.1.4. Загрузка файлов на сервер

Загрузите в созданную на предыдущем шаге папку:

JAR-файл модуля;

файл настроек конфигурации модуля Сервис формирования документов (

application.yml);файлы JDBC-драйвер (

dtm-jdbc-driver-*.*.*.jar) иcommons-lang3-3.12.0.jarдля подключения к Prostore.

3.1.6.1.5. Кластеризация модуля

Кластеризация модуля достигается путем запуска копии экземпляра данного модуля. Оптимальным вариантом является использование оркестраторов, например:

Kubernetes;

Openshift;

Docker-swarm;

Nomad.

3.1.7. Установка стандартного загрузчика

3.1.7.1. Процесс установки

Действия по установке выполняются через SSH консоль технологического пользователя.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии компонентов модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить модуль (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.7.1.1. Предусловия выполнения первого запуска новой версии компонентов загрузчика

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Миграции подлежат данные только таблиц, предназначенных для хранения статической информации:

information_system;

source;

pull_task;

schedule;

deployer;

reader;

config;

flk_conditions;

session_status_dictionary;

compare_task;

compare_schedule.

Для исключения возникновения ошибок миграции, перед первым запуском новой версии компонентов загрузчика необходимо выполнить следующие действия:

Проверить версию Prostore (для работы новой версии загрузчика требуется Prostore версии 7.6 и выше).

Проверить тип подключенных датасорсов Prostore (в Prostore данные персистентности хранятся в snapshot-таблицах, которые поддерживаются только типом ADP):

если все имеющиеся датасорсы с типом ADP, перейти к следующему шагу;

если нет ни одного ADP-датасорса, то необходимо развернуть СУБД PostgreSQL и настроить подключение к Prostore (при отсутствии ADP использование новой версии стандартного загрузчика невозможно);

если имеются и ADP, и датасорсы других типов, необходимо в конфигурационном файле загрузчика задать перечень наименований ADP-датасорсов, используемых для обеспечения персистентности;

Остановить формирование новых сеансов: закрыть доступ клиентов к ридерам типа push сетевыми средствами, перевести все расписания и для заданий типа pull, и для сверок в выключенное состояние.

Дождаться перехода всех сеансов в финальные статусы (проверка возможна с использованием REST-запроса на получение списка сеансов с фильтрацией по неконечным статусам).

Проверить наличие ошибочных статусов сеансов загрузки и ошибок ФЛК.

Обработать ошибочные статусы и ошибки ФЛК (в случае наличия ошибок загрузки данных, необходимо устранить причину и повторить загрузку до первого запуска загрузчика версии 2.6.0 и выше, т.к. история будет утеряна).

Остановить загрузчик.

Запустить загрузчик новой версии (2.6.0 или выше) со всеми задействованными компонентами (Manager и Buffer - обязательно, FLK и Comparator - опционально) в одном экземпляре (допускается запуск как в одной, так и в различных JVM). В случае запуска в нескольких экземпляров возможны ошибки при выполнении миграции.

После успешного выполнения миграции (компонент запущен, в логах отсутствуют ошибки миграции) выполнить запуск других экземпляров при необходимости.

В случае наличия в логах ошибок миграции, необходимо устранить возможные причины и повторить запуск одного экземпляра компонентов загрузчика версии 2.6.0 и выше.

3.1.7.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в разделе

Конфигурация стандартного загрузчика Руководства администратора Компонент «Витрина данных».

3.1.7.1.3. Загрузка JAR-файла на сервер

Для загрузки файла на сервер выполните команду:

scp file.jar user_name@IP:/home/dir

где,

file.jar- название JAR-файла;user_name- имя пользователя, например,sudoилиroot;IP- адрес сервера;/home/dir- директория на сервере, в которую будет загружен файл.

3.1.8. Установка CSV-Uploader

3.1.8.1. Процесс установки CSV-uploader

Действия по установке выполняются через SSH консоль технологического пользователя.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить модуль (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.8.1.1. Предусловия выполнения первого запуска новой версии модуля

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Для исключения возникновения ошибок миграции, перед первым запуском новой версии модуля необходимо выполнить следующие действия:

Проверить версию Prostore (для работы новой версии CSV-Uploader требуется Prostore версии 7.6 и выше).

Проверить тип подключенных датасорсов Prostore (В Prostore данные персистентности хранятся в snapshot-таблицах, которые поддерживаются только в датасорсах с типом ADP):

если все имеющиеся датасорсы с типом ADP, перейти к следующему шагу;

если нет ни одного ADP-датасорса, то необходимо развернуть СУБД PostgreSQL и настроить подключение к Prostore (при отсутствии ADP использование новой версии CSV-Uploader с персистентностью в Prostore невозможно);

если имеются и ADP, и датасорсы других типов, необходимо в конфигурационном файле CSV-Uploader задать перечень наименований ADP датасорсов, используемых для обеспечения персистентности;

Дождаться перехода выполняющихся загрузок в финальные статусы.

Проверить наличие ошибочных статусов загрузки и ошибок ФЛК, обработать ошибки (в случае наличия ошибок загрузки данных, необходимо устранить причину и повторить загрузку до обновления CSV-Uploader, т.к. данные журналов загрузок не подлежат миграции).

Отключить автоматическую загрузку данных в витрину по расписанию.

Остановить CSV-Uploader.

Запустить новую версию CSV-uploader в одном экземпляре (в случае запуска нескольких экземпляров возможны ошибки при выполнении миграции).

После успешного выполнения миграции (модуль запущен, в логах отсутствуют ошибки миграции) выполнить запуск других экземпляров при необходимости.

В случае наличия в логах ошибок миграции, необходимо устранить возможные причины и повторить запуск одного экземпляра CSV-uploader версии 2.6.0 и выше.

3.1.8.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в разделе

Конфигурация CSV-uploader (application.yml) Руководства администратора Компонент «Витрина данных».

3.1.8.1.3. Загрузка JAR-файла на сервер

Для загрузки файла на сервер выполните команду:

scp file.jar user_name@IP:/home/dir

где,

file.jar- название JAR-файла;user_name- имя пользователя, например,sudoилиroot;IP- адрес сервера;/home/dir- директория на сервере, в которую будет загружен файл.

3.1.9. Установка DATA-uploder – Модуля исполнения асинхронных заданий

3.1.9.1. Процесс установки

Действия по установке выполняются через SSH консоль технологического пользователя.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить модуль (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.9.1.1. Предусловия выполнения первого запуска новой версии модуля

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Для исключения возникновения ошибок миграции, перед первым запуском новой версии модуля необходимо выполнить следующие действия:

Проверить версию Prostore (для работы новой версии DATA-Uploader требуется Prostore версии 7.6 и выше).

Проверить тип подключенных датасорсов Prostore (В Prostore данные персистентности хранятся в snapshot-таблицах, которые поддерживаются только в датасорсах с типом ADP):

если все имеющиеся датасорсы с типом ADP, перейти к следующему шагу;

если нет ни одного ADP-датасорса, то необходимо развернуть СУБД PostgreSQL и настроить подключение к Prostore (при отсутствии ADP невозможно использование функционала сбора данных о компонентах в новой версии Витрин данных);

если имеются и ADP, и датасорсы других типов, необходимо в конфигурационном файле DATA-Uploader задать перечень наименований используемых ADP-датасорсов;

Синхронизировать настройки блока component-info (кроме secrets) в конфигурационных файлах всех модулей, отправляющих информацию о себе.

Запустить один экземпляр одного из модулей ВД новой версии с включенным функционалом сбора данных (

component-info.enabled: true) и с заданными настройками подключения к Prostore (в случае запуска нескольких экземпляров или нескольких компонентов возможны ошибки пересоздания таблицыcomponent_info).

После успешного выполнения миграции необходимо убедиться в успешности создания таблицы component_info.

В случае наличия в логах ошибок создания таблицы component_info, необходимо устранить возможные причины и перезапустить один экземпляр одного модуля Витрины новой

версии или дождаться выполнения повторной попытки создания таблицы (периодичность конфигурируется в параметре component-info.create-table-period).

3.1.9.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в разделе

Конфигурация модуля DATA-Uploader (application.yml) Руководства администратора Компонент «Витрина данных».

3.1.9.1.3. Загрузка JAR-файла на сервер

Для загрузки файла на сервер выполните команду:

scp file.jar user_name@IP:/home/dir

где,

file.jar- название JAR-файла;user_name- имя пользователя, например,sudoилиroot;IP- адрес сервера;/home/dir- директория на сервере, в которую будет загружен файл.

3.1.10. Установка REST-uploader – Модуля асинхронной загрузки данных из сторонних источников

3.1.10.1. Процесс установки

Действия по установке выполняются через SSH консоль технологического пользователя.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить модуль (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.10.1.1. Предусловия выполнения первого запуска новой версии модуля

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Для исключения возникновения ошибок миграции, перед первым запуском новой версии модуля необходимо выполнить следующие действия:

Проверить версию Prostore (для работы новой версии REST-Uploader требуется Prostore версии 7.6 и выше).

Проверить тип подключенных датасорсов Prostore (В Prostore данные персистентности хранятся в snapshot-таблицах, которые поддерживаются только в датасорсах с типом ADP):

если все имеющиеся датасорсы с типом ADP, перейти к следующему шагу;

если нет ни одного ADP-датасорса, то необходимо развернуть СУБД PostgreSQL и настроить подключение к Prostore (при отсутствии ADP невозможно использование функционала сбора данных о компонентах в новой версии Витрин данных);

если имеются и ADP, и датасорсы других типов, необходимо в конфигурационном файле REST-Uploader задать перечень наименований используемых ADP-датасорсов;

Синхронизировать настройки блока component-info (кроме secrets) в конфигурационных файлах всех модулей, отправляющих информацию о себе.

Запустить один экземпляр одного из модулей ВД новой версии с включенным функционалом сбора данных (

component-info.enabled: true) и с заданными настройками подключения к Prostore (в случае запуска нескольких экземпляров или нескольких компонентов возможны ошибки пересоздания таблицыcomponent_info).

После успешного выполнения миграции необходимо убедиться в успешности создания таблицы component_info.

В случае наличия в логах ошибок создания таблицы component_info, необходимо устранить возможные причины и перезапустить один экземпляр одного модуля Витрины новой

версии или дождаться выполнения повторной попытки создания таблицы (периодичность конфигурируется в параметре component-info.create-table-period).

3.1.10.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в разделе Конфигурация модуля REST-Uploader (application.yml)

Руководства администратора Компонента «Витрина данных».

3.1.10.1.3. Загрузка JAR-файла на сервер

Для загрузки файла на сервер выполните команду:

scp file.jar user_name@IP:/home/dir

где,

file.jar- название JAR-файла;user_name- имя пользователя, например,sudoилиroot;IP- адрес сервера;/home/dir- директория на сервере, в которую будет загружен файл.

3.1.11. Установка сервиса генерации уникального номера (Counter-Provider)

3.1.11.1. Процесс установки

Действия по установке выполняются через SSH консоль технологического пользователя.

Общий процесс установки состоит из следующих действий:

Выполнить предусловия для запуска новой версии модуля.

Настроить конфигурацию модуля.

Создать на сервере директорию для загрузки файлов модуля.

Загрузить файлы модуля в созданную директорию.

Запустить модуль (Описание процесса запуска приведено в разделе Запуск модуля Руководства администратора Компонента «Витрина данных»).

Проверить установку модуля.

3.1.11.1.1. Предусловия выполнения первого запуска новой версии Counter-provider с персистентностью в Prostore

Начиная с версии 2.6.0 хранение данных персистентности модуля осуществляется в снапшот-таблицах Prostore. Пересоздание таблиц и миграция данных выполняется автоматически при старте модуля.

Для исключения возникновения ошибок миграции, перед первым запуском новой версии модуля необходимо выполнить следующие действия:

Задать необходимые настройки в конфигурационном файле модуля новой версии.

При кастомизации шага инкремента номеров счетчиков (

counter.increment-gap), он устанавливается одинаковым для всех экземпляров модуля.При установке

increment-gap >1возможны пропуски генерируемой последовательности значений после обновления или при перезапуске модуля Counter-provider.

Опционально - включить выполнение миграции счётчиков из Zookeeper (В конфигурационном файле нового Counter-provider задать настройки подключения к Zookeeper и установить флаг выполнения миграции из Zookeeper).

Для обновления выбрать период минимальной прикладной активности.

Остановить Counter-provider.

Запустить новую версию Counter-provider в одном экземпляре (В случае запуска нескольких экземпляров возможны ошибки при выполнении миграции).

После успешного выполнения миграции (модуль запущен, в логах отсутствуют ошибки миграции) необходимо в конфигурации модуля отключить выполнение миграции из Zookeeper (если была включена) и выполнить запуск других экземпляров при необходимости.

В случае наличия в логах ошибок миграции, необходимо устранить возможные причины и повторить запуск одного экземпляра Counter-provider новой версии.

3.1.11.1.2. Настройка конфигурации

Настройка конфигурации выполняется путем редактирования параметров файла конфигурации application.yml.

Пример файла application.yml и возможные настройки конфигурации модуля приведены в

разделе Конфигурация модуля Counter-Provider (application.yml) Руководства администратора Компонента «Витрина данных».

3.1.11.1.3. Загрузка JAR-файла на сервер

Для загрузки файла на сервер выполните команду

scp file.jar user_name@IP:/home/dir

где,

file.jar- название JAR-файла;user_name- имя пользователя, например,sudoилиroot;IP- адрес сервера;/home/dir- директория на сервере, в которую будет загружен файл.

3.1.12. Установка Агента проверок

3.1.12.1. Подготовка и настройка системы для запуска Агента проверок

3.1.12.1.1. Установка и подключение к Prostore

Для работы Агента проверок необходимо установить ПО Prostore и подключение к нему (Раздел 3.1.2).

Между Агентом проверок и ПО Prostore должна быть обеспечена сетевая связанность.

В конфигурационный файл application.yml ПО Prostore необходимо добавить настройки по отправке push-уведомлений в Агента проверок,

для уведомлений последнего об изменениях, вносимых в проверяемые таблицы:

core:

poststatusevent:

subscriberGroup:

- endpointUrl: "http://<IP-Агента-проверок>:<port-Агента проверок>/check/adapter/push/enrich"

endpointTimeoutMs: 10000

endpointRetryTimeoutMs: 5000

bufferingPeriodMs: 5000

bufferSize: 2000

writeOperationsEnabled: true

externalDDLEnabled: true

3.1.12.1.2. Установка и подключение интеграционного узла адаптера

Для сверки данных Компонента «Витрина Данных» с Единым реестром населения (далее - ЕРН), необходимо выполнить установку компонента «Интеграционный узел адаптера» (далее ИУА) для взаимодействия через СМЭВ 3, согласно документу «Руководство администратора ИУА».

Между Агентом проверок и ИУА должна быть обеспечена сетевая связанность.

В случае взаимодействия через СМЭВ 3 при помощи Адаптера СМЭВ 3, установка компонента ИУА не требуется.

3.1.12.1.3. Перечень стороннего ПО и доступов, необходимых для работы Агента проверок

JDK версии 17.0, рекомендуется Liberica 17 JDK 17.0.7;

необходимо зарегистрировать спецификации

/dqfи/api/v1/incidents, приведенные в Раздел 2.2.2.4;перечень доступов к спецификациям в качестве инициатора приведен в Таблица 3.1;

перечень доступов к спецификациям в качестве поставщика приведен в Таблица 3.2. Владельцем указанных спецификаций является ИС Агента СМЭВ 4, установленная в контуре Компонента «Витрина данных».

Спецификация |

Мнемоника ИС Владельца спецификации |

Назначение |

|---|---|---|

|

04PV02 |

Получение списка согласованных проверок |

|

04PV02 |

Передача статистики по результатам проверок |

|

MNSV20 |

Получение данных справочников ЕСНСИ (только тип ЕСНСИ) |

|

04PV02 |

Передача статистики по результатам проверок в разрезе таблиц |

Спецификация |

Мнемоника ИС которой необходимо предоставить доступ к спецификации |

Назначение |

|---|---|---|

|

04PV02 |

Выполнение тестирования проверок качества данных, до их публикации и применения к витрине данных |

|

MNSV171 |

Прием результатов сверок и сопоставлений данных подсистемой ЕСУМД ФГИС «Моя школа» |

3.1.13. Установка коннектора Kafka-Postgres

Из полученного дистрибутива компонента скопируйте и загрузите в папку kafka-postgres-connector архив

kafka-postgres-writer-1.5.0.jarСкопируйте конфигурационный файл KAFKA-POSTGRES-WRITER

application.yamlв папку kafka-postgres-connector/config.

Конфигурационный файл KAFKA-POSTGRES-WRITER

logging:

level:

ru.datamart.kafka: ${LOG_LEVEL:DEBUG}

org.apache.kafka: ${KAFKA_LOG_LEVEL:INFO}

http:

port: ${SERVER_PORT:8096}

vertx:

pools:

eventLoopPoolSize: ${VERTX_EVENT_LOOP_SIZE:12}

workersPoolSize: ${VERTX_WORKERS_POOL_SIZE:32}

verticle:

query:

instances: ${QUERY_VERTICLE_INSTANCES:12}

insert:

poolSize: ${INSERT_WORKER_POOL_SIZE:32}

insertPeriodMs: ${INSERT_PERIOD_MS:1000}

batchSize: ${INSERT_BATCH_SIZE:500}

consumer:

poolSize: ${KAFKA_CONSUMER_WORKER_POOL_SIZE:32}

maxFetchSize: ${KAFKA_CONSUMER_MAX_FETCH_SIZE:10000}

commit:

poolSize: ${KAFKA_COMMIT_WORKER_POOL_SIZE:1}

commitPeriodMs: ${KAFKA_COMMIT_WORKER_COMMIT_PERIOD_MS:1000}

client:

kafka:

consumer:

checkingTimeoutMs: ${KAFKA_CHECKING_TIMEOUT_MS:10000}

responseTimeoutMs: ${KAFKA_RESPONSE_TIMEOUT_MS:10000}

consumerSize: ${KAFKA_CONSUMER_SIZE:10}

closeConsumersTimeout: ${KAFKA_CLOSE_CONSUMER_TIMEOUT:15000}

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:kafka.host:9092}

group.id: ${KAFKA_CONSUMER_GROUP_ID:postgres-query-execution}

auto.offset.reset: ${KAFKA_AUTO_OFFSET_RESET:earliest}

enable.auto.commit: ${KAFKA_AUTO_COMMIT:false}

auto.commit.interval.ms: ${KAFKA_AUTO_INTERVAL_MS:1000}

datasource:

postgres:

database: ${POSTGRES_DB_NAME:test}

user: ${POSTGRES_USERNAME:dtm}

password: ${POSTGRES_PASS:dtm}

hosts: ${POSTGRES_HOSTS:localhost:5432}

poolSize: ${POSTGRES_POOLSIZE:10}

preparedStatementsCacheMaxSize: ${POSTGRES_CACHE_MAX_SIZE:256}

preparedStatementsCacheSqlLimit: ${POSTGRES_CACHE_SQL_LIMIT:2048}

preparedStatementsCache: ${POSTGRES_CACHE:true}

3.1.14. Установка и настройка сервиса сбора данных запросов и ответов Витрины данных

Сервис сбора данных запросов и ответов Витрины данных реализован с целью проведения бизнес-мониторинга ИЭП процессов обработки запросов Компонентом «Витрина данных», как в целом, так и в части функционирования отдельных витрин для последующей передачи данных в СЦЛ.

3.1.14.1. Процесс установки

Общий процесс установки состоит из следующих действий:

Настройка логирования модулей.

Установка и настройка Vector.

Установка и настройка HaProxy.

Установка и настройка fluentbit.

Установка ClickHouse.

3.1.14.1.1. Настройка логирования модулей

Необходимо настроить формирование логов в формате JSON на стороне модулей:

BLOB-адаптер;

СМЭВ3-адаптер;

Сервис формирования документов.

Для этого необоходимо в файле logback.xml включить net.logstash.logback.encoder.LogstashEncoder.

Пример logback.xml

<?xml version="1.0" encoding="UTF-8"?>

<configuration>

<appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<file>logs/application.log</file>

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<!-- daily rollover -->

<fileNamePattern>logs/application.%d{yyyy-MM-dd}.log</fileNamePattern>

<!-- keep 30 days' worth of history capped at 3GB total size -->

<maxHistory>30</maxHistory>

<totalSizeCap>3GB</totalSizeCap>

</rollingPolicy>

<encoder class="net.logstash.logback.encoder.LogstashEncoder" />

</appender>

<root level="INFO">

<appender-ref ref="FILE" />

</root>

</configuration>

3.1.14.1.2. Установка и настройка Vector

Установка производится по официальной документации Vector

Настройка Vector:

Пример настройки source:

json_source:

type: fluent

address: 0.0.0.0:24226

Пример фильтрации сообщений, имеющих флаг scl:

scl_tags_filter:

type: filter

inputs:

- json_source

condition:

type: "vrl"

source: |-

exists(.tags) && includes(array!(.tags), "TYPE_SCL")

Пример парсинга scl-сообщений:

scl_message_remap:

type: remap

inputs:

- scl_tags_filter

source: |-

. = parse_json!(.message)

Пример отправки scl-сообщений в Kafka:

podd_agent_sink:

type: kafka

inputs:

- scl_message_remap

bootstrap_servers: kafka:9092

topic: "<префикс>.scl.signal"

acknowledgements: true

compression: "gzip"

encoding:

codec: json

healthcheck: true

3.1.14.1.3. Установка и настройка HaProxy

Установка производится по официальной документации HaProxy

Для настройки HaProxy в секции backend нужно перечислить список установленных инстансов Vector.

Пример файла haproxy.cfg:

global

log 127.0.0.1 local2

chroot /var/lib/haproxy

pidfile /var/run/haproxy.pid

maxconn 4000

user haproxy

group haproxy

daemon

stats socket /var/lib/haproxy/stats

defaults

mode tcp

log global

retries 3

maxconn 3000

listen stats

bind 0.0.0.0:1936

mode http

stats enable

stats uri /

frontend services

bind 0.0.0.0:24226

default_backend services

mode tcp

backend services

balance roundrobin

mode tcp

server vector01 vector-01:24226

server vector02 vector-02:24226

3.1.14.1.4. Установка и настройка FluentBit

Установка производится по официальной документации FluentBit.

Далее необходимо настроить FluentBit на чтение файлов с логами приложений.

Пример файла конфигурации fluent-bit.conf:

[SERVICE]

flush 5

daemon off

log_level info

parsers_file parsers.conf

[INPUT]

name tail

path <путь до лог файла приложения>

tag *

parser json

[OUTPUT]

name forward

match *

host haproxy

port 24226

Пример файла parsers.conf:

[PARSER]

Name json

Format json

На этом настройка fluentbit завершена.

3.1.14.1.4.1. Включение / выключение отправки сообщений в СЦЛ

Отправка логов в СЦЛ осуществляется автоматически после корректной настройки сервиса.

Для выключения отправки логов можно закомментировать блок podd_agent_sink отправки сообщений в Kafka в настройках Vector.

3.1.14.1.5. Установка и настройка ClickHouse

Установка производится по официальной документации ClickHouse

Пример задания конфигурационных настроек:

clickhouse_default_config:

clickhouse:

logger:

level: trace

log: /var/log/clickhouse-server/clickhouse-server.log

errorlog: /var/log/clickhouse-server/clickhouse-server.err.log

size: 1000M

count: 10

http_port: 8123

tcp_port: 9000

listen_host: 0.0.0.0

max_connections: 4096

keep_alive_timeout: 3

user_directories:

users_xml:

path: users.xml

local_directory:

path: "{{ clickhouse_root_data_folder }}/access/"

path: "{{ clickhouse_root_data_folder | add_slash }}"

3.2. Установка Компонента «Витрина данных» конфигурации лайт

Примечание

Перед установкой Компонента необходимо обязательно выполнить предварительные действия по настройке (см. раздел Предварительные действия).

Состав модулей дистрибутива и номер версии Компонента приведены в разделе Состав модулей в дистрибутиве документа «Техническое описание Компонента «Витрина данных».

Требования к серверному оборудованию, телекоммуникационному оборудованию и каналам связи приведены в Раздел 1 документа «Техническое описание Компонента «Витрина данных»».

3.2.1. Настройка конфигурационного файла

Чтобы запустить процесс установки Компонента с помощью Ansible, необходимо настроить конфигурационный файл. Для этого выполните следующие действия:

Переименовать файл

custom.example.ymlрасположенный в папке ansible/group_vars/ вcustom.yml. Для этого выполните команду:

cp -n ansible/group_vars/custom.example.yml ansible/group_vars/custom.yml

В файле

custom.ymlуказать корректные значения для следующих переменных:

server_ip- адреса сервера. Укажите IP-адрес сервера, на который будет установлено обновление Компонента, например:

server_ip: "172.16.10.59"

Если установка производится локально, то нужно выставить server_ip: "localhost".

server_user_name- имя пользователя операционной системы. Укажите имя пользователя операционной системы сервера, под которым будет производиться установка Компонента (см. раздел Создание пользователя datamart), например:

server_user_name: datamart

3.2.2. Установка Компонента

Для установки Компонента выполните команду:

docker-ansible-cmd ansible-playbook -i hosts install.yml

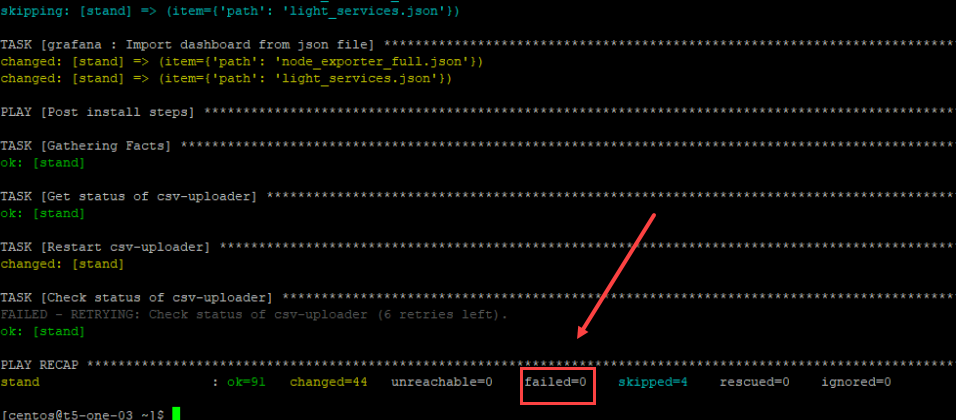

Начнется процесс установки Компонента (см. Рисунок - 3.6):

Рисунок - 3.6 Процесс установки

Установка Компонента завершена. При успешной установке параметр failed должен иметь значение - 0 (см. Рисунок - 3.6).

Это значит, что все компоненты Компонента установлены, а необходимые взаимосвязи между ними настроены корректно.

После установки Компонента следует провести ее проверку.

3.3. Установка системы мониторинга

Для мониторинга состояния работы Компонента «Витрина данных» используется связка Grafana + Prometheus.

Prometheus — система мониторинга, обладающая возможностями тонкой настройки метрик. Prometheus используется для отслеживания состояния работы компонентов системы на низком уровне.

Grafana — инструмент с открытым исходным кодом для визуализации данных из различных систем сбора статистики. Grafana используется для представления в графическом виде временных рядов и текстовых данных.

Для Grafana и Prometheus доступны установки как на Bare metal, так и под Docker.

Примечание

Описание настроек системы мониторинга приведено в разделе Настройка сервиса мониторинга документа «Руководство администратора Типового ПО «Витрина данных»».

3.3.1. Установка Prometheus на Bare metal

3.3.1.1. Подготовка сервера

Перед установкой нужно настроить параметры сервера, необходимые для правильно работы системы.

Установите пакеты, нужные для работы:

wget - для загрузки файлов;

tar - для распаковки архивов.

В зависимости от системы, команды будут отличаться.

yum updateinfo

yum install wget tar

apt update

apt install wget tar

Проверьте, что установлен нужный часовой пояс (описание настройки часового пояса приведено в разделе Выбор часового пояса).

На фаерволе, при его использовании, откройте порт TCP 9090 — HTTP для сервера Prometheus.

Используя IPtables откройте порт командой:

iptables -I INPUT -p tcp --match multiport --dports 9090 -j ACCEPT

Сохраните правила с помощью iptables-persistent:

service iptables save

apt install iptables-persistent

netfilter-persistent save

3.3.1.2. Установка Prometheus

Prometheus не устанавливается из репозитория и имеет не простой процесс установки.

Необходимо скачать исходник, создать пользователя, вручную скопировать нужные файлы, назначить права и создать юнит для автозапуска.

3.3.1.2.1. Загрузка

Для загрузки нужно перейдите на официальную страницу загрузки, скопируйте ссылку на пакет для Linux (желательно, использовать версию LTS) и загрузите пакет командой:

wget https://github.com/prometheus/prometheus/releases/download/v2.45.0/prometheus-2.45.0.linux-amd64.tar.gz

Примечание

Если система вернет ошибку, необходимо установить пакет wget.

3.3.1.2.2. Установка (копирование файлов)

После скачивания архива Prometheus, необходимо его распаковать и скопировать содержимое по разным каталогам.

Создайте каталоги, в которые нужно скопировать файлы для Prometheus командой:

mkdir /etc/prometheus /var/lib/prometheus

Распакуйте архив командой:

tar -zxf prometheus-*.linux-amd64.tar.gz

Перейдите в каталог с распакованными файлами:

cd prometheus-*.linux-amd64

Распределите файлы по каталогам:

cp prometheus promtool /usr/local/bin/

cp -r console_libraries consoles prometheus.yml /etc/prometheus

Выйдите из каталога и удалите исходник:

cd .. && rm -rf prometheus-*.linux-amd64/ && rm -f prometheus-*.linux-amd64.tar.gz

3.3.1.2.3. Назначение прав

Создайте пользователя, который будет запускать систему мониторинга:

useradd --no-create-home --shell /bin/false prometheus

Примечание

Данная команда создает пользователя Prometheus без домашней директории и без возможности входа в консоль сервера.

Задайте владельца для каталогов, которые были созданы ранее:

chown -R prometheus:prometheus /etc/prometheus /var/lib/prometheus

Задайте владельца для скопированных файлов:

chown prometheus:prometheus /usr/local/bin/{prometheus,promtool}

3.3.1.2.4. Запуск и проверка

Запусите Prometheus от одноименного пользователя командой:

sudo -u prometheus /usr/local/bin/prometheus --config.file /etc/prometheus/prometheus.yml --storage.tsdb.path /var/lib/prometheus/ --web.console.templates=/etc/prometheus/consoles --web.console.libraries=/etc/prometheus/console_libraries

Система выведет в консоль лог запуска с сообщением в конце:

level=info ts=2019-08-07T07:39:06.849Z caller=main.go:621 msg="Server is ready to receive web requests."

В браузере введите адрес:

http://<IP-адрес сервера>:9090— в случае успешной установки загрузится консоль Prometheus.

3.3.1.2.5. Автозапуск

Для настройки автоматического старта Prometheus нужно создать новый юнит в systemd.

Откройте консоль сервера, прервать работу Prometheus с помощью комбинации Ctrl + C и создать файл

prometheus.service:

vi /etc/systemd/system/prometheus.service

[Unit]

Description=Prometheus Service

Documentation=https://prometheus.io/docs/introduction/overview/

After=network.target

[Service]

User=prometheus

Group=prometheus

Type=simple

ExecStart=/usr/local/bin/prometheus \

--config.file /etc/prometheus/prometheus.yml \

--storage.tsdb.path /var/lib/prometheus/ \

--web.console.templates=/etc/prometheus/consoles \

--web.console.libraries=/etc/prometheus/console_libraries

ExecReload=/bin/kill -HUP $MAINPID

Restart=on-failure

[Install]

WantedBy=multi-user.target

Разрешите автозапуск:

systemctl enable prometheus

Запустите службу:

systemctl start prometheus

Проверьте корректность запуска:

systemctl status prometheus

3.3.2. Установка Grafana на Bare metal

Создайте файл конфигурации репозитория:

vi /etc/yum.repos.d/grafana.repo

[grafana]

name=grafana

baseurl=https://packages.grafana.com/oss/rpm

repo_gpgcheck=1

enabled=1

gpgcheck=1

gpgkey=https://packages.grafana.com/gpg.key

sslverify=1

sslcacert=/etc/pki/tls/certs/ca-bundle.crt

Установите Grafana командой:

yum install grafana

На вопросы системы, задаваемые в процессе установки выберите ответ: Y.

Добавьте репозиторий командой:

add-apt-repository "deb https://packages.grafana.com/oss/deb stable main"

Установите ключ для проверки подлинности репозитория Grafana:

wget -q -O - https://packages.grafana.com/gpg.key | apt-key add -

Обновите список портов:

apt update

Установите Grafana:

apt install grafana

На вопросы системы, задаваемые в процессе установки выберите ответ: Y.

3.3.2.1. Настройка брэндмауэра

По умолчанию, Grafana работает на порту 3000.

Для возможности подключиться к серверу откройте данный порт командой:

iptables -A INPUT -p tcp --dport 3000 -j ACCEPT

Сохраните правила с помощью iptables-persistent:

service iptables save

netfilter-persistent save

Примечание

Eсли при вводе второй команды система выдаст ошибку, нужно установить пакет командой apt install iptables-persistent.

3.3.2.2. Запуск Grafana

Разрешите автозапуск командой:

systemctl enable grafana-server

Запустите сервис:

systemctl start grafana-server

3.3.3. Установка Prometheus и Grafana в Docker

Для этого варианта установки необходимо установить Docker.

Описание установки Docker приведено в разделе docker_install.

Для того чтобы установить Prometheus и Grafana создайте файл docker-compose.yml со следующим содержимым:

version: '3.3'

networks:

monitoring:

driver: bridge

volumes:

prometheus_data: {}

services:

grafana:

image: grafana/grafana-enterprise

container_name: grafana

restart: unless-stopped

ports:

- 3000:3000

prometheus:

image: prom/prometheus:latest

container_name: prometheus

restart: unless-stopped

volumes:

- ./prometheus.yml:/etc/prometheus/prometheus.yml

- prometheus_data:/prometheus

command:

- '--config.file=/etc/prometheus/prometheus.yml'

- '--storage.tsdb.path=/prometheus'

- '--web.console.libraries=/etc/prometheus/console_libraries'

- '--web.console.templates=/etc/prometheus/consoles'

- '--web.enable-lifecycle'

ports:

- 9090:9090

networks:

- monitoring

В примере выше указан путь к корневой папке с которой будет запущен docker-compose файл.

Для Prometheus укажите папку в которой будет располагаться файл конфигурации prometheus.yml.

Пример файла приведен в разделе Настройка конфигурационного файла Prometheus.

После этого вернитесь на уровень выше, где находится файл docker-compose.yml и выполнить установку командой:

docker-compose up -d

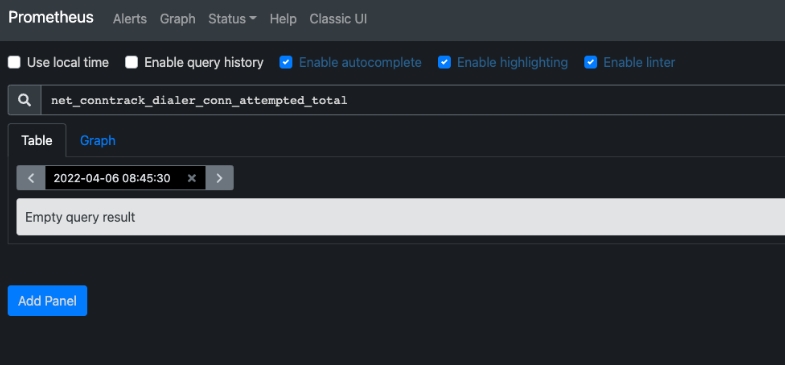

После установки Prometheus будет доступен по адресу http://ip:9090

Рисунок - 3.7 Доступ Prometheus

Веб-интерфейс Grafana будет доступен по адресу http://ip:3000.

Для авторизации введите логин viewer и пароль viewer.

Рисунок - 3.8 Авторизация в Grafana

3.4. Подключение к Агенту СМЭВ4

Установка и настройка Агента СМЭВ4 осуществляется согласно документу «Руководство администратора Агента СМЭВ4».

Примечание

Для сопряжения Компонента «Витрина данных» и ИС УВ с Ядром СМЭВ4 необходимо использовать Агент СМЭВ4 версии не ниже 3.23.0.

Настройка взаимодействия Агента СМЭВ4 с Prostore на стороне Витрины по протоколу HTTP осуществляется в соответствии с разделом «Взаимодействие с Витринами данных по HTTP (версия Витрины 2.x)» Руководства администратора Агента СМЭВ4.