2. Настройка программы

2.1. Настройка на состав технических средств

Серверы, на которых будет установлена Программа, должны соответствовать техническим характеристикам указанным в документе «Техническое описание системы» раздел «Рекомендуемые технические и программные средства», в котором приводится информация о требованиях к серверному оборудованию (CPU, RAM, HDD и т.д.), программному обеспечению и требования к каналам связи.

Необходимые настройки для серверов описаны в документе «Руководство по установке», в котором приводится информация об общих требованиях к серверам, требуемой доступности портов для каждого сервера, настройка протоколов, наличие библиотек и т.д.

2.2. Настройка на состав программных средств

Все предварительные действия необходимые перед установкой программы, процесс установки и проверка корректной установки программы описан в документе «Руководство по установке».

2.2.1. Настройка ProStore

2.2.1.1. Настройка Сервиса исполнения запросов (query-execution)

2.2.1.1.1. Пример файла application.yml

Файл application.yml – основной конфигурационный файл, в котором задана логика и порядок работы Сервиса исполнения запросов (query-execution). Для первоначальной установки используйте значения «по умолчанию».

Пример файла application.yml со всеми конфигурируемыми атрибутами, приведен ниже:

logging:

level:

io.arenadata.dtm.query.execution: ${WRITER_LOG_LEVEL:INFO}

org.apache.kafka.clients: ERROR

management:

server:

port: ${DTM_METRICS_PORT:8080}

endpoints:

enabled-by-default: true

web:

exposure:

include: info, health, requests

core:

plugins:

active: ${CORE_PLUGINS_ACTIVE:ADG, ADB, ADQM, ADP}

http:

port: ${DTM_CORE_HTTP_PORT:9090}

tcpNoDelay: ${DTM_CORE_HTTP_TCP_NO_DELAY:true}

tcpFastOpen: ${DTM_CORE_HTTP_TCP_FAST_OPEN:true}

tcpQuickAck: ${DTM_CORE_HTTP_TCP_QUICK_ACK:true}

env:

name: ${DTM_NAME:test}

settings:

timeZone: ${CORE_TIME_ZONE:UTC}

metrics:

isEnabled: ${DTM_CORE_METRICS_ENABLED:true}

datasource:

edml:

sourceType: ${EDML_DATASOURCE:ADG}

defaultChunkSize: ${EDML_DEFAULT_CHUNK_SIZE:1000}

pluginStatusCheckPeriodMs: ${EDML_STATUS_CHECK_PERIOD_MS:3000}

firstOffsetTimeoutMs: ${EDML_FIRST_OFFSET_TIMEOUT_MS:15000}

changeOffsetTimeoutMs: ${EDML_CHANGE_OFFSET_TIMEOUT_MS:10000}

zookeeper:

connection-string: ${ZOOKEEPER_DS_ADDRESS:localhost}

connection-timeout-ms: ${ZOOKEEPER_DS_CONNECTION_TIMEOUT_MS:30000}

session-timeout-ms: ${ZOOKEEPER_DS_SESSION_TIMEOUT_MS:86400000}

chroot: ${ZOOKEEPER_DS_CHROOT:/adtm}

kafka:

producer:

property:

key.serializer: org.apache.kafka.common.serialization.StringSerializer

value.serializer: org.apache.kafka.common.serialization.StringSerializer

cluster:

zookeeper:

connection-string: ${ZOOKEEPER_KAFKA_ADDRESS:localhost}

connection-timeout-ms: ${ZOOKEEPER_KAFKA_CONNECTION_TIMEOUT_MS:30000}

session-timeout-ms: ${ZOOKEEPER_KAFKA_SESSION_TIMEOUT_MS:86400000}

chroot: ${ZOOKEEPER_KAFKA_CHROOT:}

admin:

inputStreamTimeoutMs: ${KAFKA_INPUT_STREAM_TIMEOUT_MS:2000}

status.event.publish:

enabled: true

topic: status.event

statusMonitorUrl: ${STATUS_MONITOR_URL:http://localhost:9095/status}

cache:

initialCapacity: ${CACHE_INITIAL_CAPACITY:100000}

maximumSize: ${CACHE_MAXIMUM_SIZE:100000}

expireAfterAccessMinutes: ${CACHE_EXPIRE_AFTER_ACCESS_MINUTES:99960}

adb:

datasource:

user: ${ADB_USERNAME:gpadmin}

password: ${ADB_PASS:gpadmin}

host: ${ADB_HOST:localhost}

port: ${ADB_PORT:5432}

maxSize: 20

fetchSize: ${ADB_FETCH_SIZE:1000}

mppw:

consumerGroup: ${ADB_LOAD_GROUP:adb-emulator-load-adb}

poolSize: ${ADB_MPPW_POOL_SIZE:2}

stopTimeoutMs: ${ADB_MPPW_STOP_TIMEOUT_MS:86400000}

defaultMessageLimit: ${ADB_MPPW_DEFAULT_MESSAGE_LIMIT:100}

fdwTimeoutMs: ${ADB_MPPW_FDW_TIMEOUT_MS:1000}

adg:

tarantool:

db:

host: ${TARANTOOL_DB_HOST:localhost}

port: ${TARANTOOL_DB_PORT:3301}

user: ${TARANTOOL_DB_USER:admin}

password: ${TARANTOOL_DB_PASS:memstorage-cluster-cookie}

operationTimeout: ${TARANTOOL_DB_OPER_TIMEOUT:60000}

engine: ${TARANTOOL_DEFAULT_ENGINE:MEMTX}

cartridge:

url: ${TARANTOOL_CATRIDGE_URL:http://localhost:8081}

mppw:

consumerGroup: ${ADG_CONSUMER_GROUP:tarantool-group-csv}

kafka:

maxNumberOfMessagesPerPartition: 200

callbackFunctionSecIdle: 100

rollback:

eraseOperationBatchSize: 300

circuitbreaker:

maxFailures: 5

timeout: 30000

fallbackOnFailure: false

resetTimeout: 10000

web-client:

max-pool-size: ${ADG_WEB_CLIENT_MAX_POOL_SIZE:100}

adqm:

datasource:

database: ${ADQM_DB_NAME:test1}

user: ${ADQM_USERNAME:default}

password: ${ADQM_PASS:}

hosts: ${ADQM_HOSTS:localhost:8123}

socketTimeout: ${ADQM_SOCKET_TIMEOUT:30000}

dataTransferTimeout: ${ADQM_DATA_TRANSFER_TIMEOUT:10000}

ddl:

cluster: ${ADQM_CLUSTER:cluster}

ttlSec: ${ADQM_TTL_SEC:3600}

archiveDisk: ${ADQM_ARCHIVE_DISK:default}

mppr:

host: ${ADQM_MPPR_CONNECTOR_HOST:localhost}

port: ${ADQM_MPPR_CONNECTOR_PORT:8086}

url: ${ADQM_MPPR_CONNECTOR_URL:/query}

mppw:

consumerGroup: ${ADQM_CONSUMER_GROUP:adqm}

kafkaBrokers: ${ADQM_BROKERS:localhost:9092}

loadType: ${ADQM_MPPW_LOAD_TYPE:REST}

restStartLoadUrl: ${ADQM_REST_START_LOAD_URL:http://localhost:8090/newdata/start}

restStopLoadUrl: ${ADQM_REST_STOP_LOAD_URL:http://localhost:8090/newdata/stop}

restLoadConsumerGroup: ${ADQM_REST_LOAD_GROUP:adb-emulator-load-adqm}

web-client:

max-pool-size: ${ADQM_WEB_CLIENT_MAX_POOL_SIZE:100}

Настройка ProStore:

DTM_CORE_PLUGINS_ANALYTICAL- настройка профилей приоритетности СУБД для запросов аналитики;DTM_CORE_PLUGINS_DICTIONARY- настройка профилей приоритетности СУБД для запросов ключ-значение;DTM_CORE_PLUGINS_UNDEFINED- настройка профилей приоритетности СУБД для не указанной категории запросов;DTM_CORE_HTTP_PORT- номер порта, на который Сервис исполнения запросов ожидает входящие запросы от JDBC-драйвера;DTM_NAME- имя среды для формирования полного наименования датамартов;CORE_TIME_ZONE- настройки временной зоны;DTM_CORE_METRICS_ENABLED- настройки генерации метрики Сервиса исполнения запросов;DTM_CORE_TASK_POOL_SIZE- максимальный объем пула задач в Cервисе исполнения запросов;DTM_CORE_TASK_TIMEOUT- интервал времени завершения задачи, выполняемой в Сервисе исполнения запросов.

Оптимизация работы сокета

TCP_NODELAY:

DTM_CORE_HTTP_TCP_NODELAY- настройка режима оптимизации работы сокетаTCP_NODELAY;DTM_CORE_HTTP_TCP_FAST_OPEN- настройка режимаTCP FAST_OPEN;DTM_CORE_HTTP_TCP_QUICK_ACK- настройка режима оптимизации работы сокетаTCP_QUICKACK.

Настройки для

EDMLоператоров:

EDML_DATASOURCE- тип СУБД-источника;EDML_DEFAULT_CHUNK_SIZE– размерchunkпо умолчанию;EDML_STATUS_CHECK_PERIOD_MS- период проверки статуса плагина в миллисекундах;EDML_FIRST_OFFSET_TIMEOUT_MS- интервал времени ожидания до таймаута в миллисекундах при работе с первым смещением;EDML_CHANGE_OFFSET_TIMEOUT_MS- интервал времени ожидания до таймаута в миллисекундах при работе с первым смещением в топике Kafka.

Настройка Zookeeper-серверов:

ZOOKEEPER_DS_ADDRESS- сетевой адрес хоста Zookeeper для служебной БД;ZOOKEEPER_DS_CONNECTION_TIMEOUT_MS- интервал времени ожидания (в миллисекундах) соединения с хостом Zookeeper для служебной БД до достижения таймаута;ZOOKEEPER_DS_SESSION_TIMEOUT_MS- интервал времени бездействия (в миллисекундах) соединения с хостом Zookeeper для служебной БД до достижения таймаута;ZOOKEEPER_DS_CHROOT- корневой путь к хосту Zookeeper для служебной БД;ZOOKEEPER_KAFKA_ADDRESS- сетевой адрес хоста Zookeeper для брокера сообщений Kafka;ZOOKEEPER_KAFKA_CONNECTION_TIMEOUT_MS- интервал времени ожидания (в миллисекундах) соединения с хостом Zookeeper для брокера сообщений Kafka до достижения таймаута;ZOOKEEPER_KAFKA_SESSION_TIMEOUT_MS- интервал времени бездействия (в миллисекундах) соединения с хостом Zookeeper для брокера сообщений Kafka до достижения таймаута;ZOOKEEPER_KAFKA_CHROOT- корневой путь к хосту Zookeeper для брокера сообщений Kafka.

Настройка Kafka-серверов:

KAFKA_INPUT_STREAM_TIMEOUT_MS– интервал времени ожидания (в миллисекундах) входного потока данных для брокера сообщений Kafka до достижения таймаута;KAFKA_STATUS_EVENT_ENABLED- разрешение на публикацию событий;KAFKA_STATUS_EVENT_TOPIC- наименование топика Kafka, в который публикуются события;STATUS_MONITOR_URL- сетевой адрес, порт и путь к Сервису мониторинга статусов Kafka.

Настройки кэширования запросов:

CACHE_INITIAL_CAPACITY- первоначальный размер кэша;CACHE_MAXIMUM_SIZE- максимальный размер кэша;CACHE_EXPIRE_AFTER_ACCESS_MINUTES- время (в минутах) устаревания кэша после последнего обращения к нему.

2.2.1.2. Настройка Сервиса мониторинга Kafka (status-monitor)

Настройка Сервиса мониторинга статусов Kafka осуществляется путём указания в соответствующем конфигурационном yml-файле параметров отслеживания файлов-топиков брокера сообщений Kafka, таких как:

смещение

consumer;содержание последнего сообщения;

время появления последнего сообщения.

Ниже, представлен пример application.yml для status-monitor с конфигурируемыми атрибутами.

2.2.1.2.1. Пример файла application.yml для status-monitor

monitor:

brokersList: ${STATUS_MONITOR_BROKERS:localhost:9092}

consumersCount: ${STATUS_MONITOR_CONSUMERS:8}

prometheus:

enabled: ${PROMETHEUS_ENABLED:true}

где,

STATUS_MONITOR_BROKERS- сетевые адреса и порты брокеров сообщений Kafka, которые отслеживает Сервис мониторинга статусов Kafka.STATUS_MONITOR_CONSUMERS- количество потребителей (consumer) Сервиса мониторинга статусов Kafka.

2.2.1.3. Настройка kafka-clickhouse-reader

kafka-clickhouse-reader - поддерживает часть функций процесса MPPR (чтение данных из Clickhouse и запись в Kafka).

Настройка kafka-clickhouse-reader осуществляется путём редактирования файла application.yml, в котором задана логика и порядок работы компонента.

2.2.1.3.1. Пример файла application.yml для kafka-clickhouse-reader

vertx:

clustered:true

logging:

level:

io.arenadata.kafka.clickhouse.reader: ${LOG_LEVEL:DEBUG}

verticle:

worker:

task-worker:

poolSize: ${TASK_WORKER_POOL_SIZE:12}

poolName: ${TASK_WORKER_POOL_NAME:task-worker}

responseTimeoutMs: ${TASK_WORKER_RESPONSE_TIMEOUT_MS:86400000}

http:

port: ${SERVER_PORT:8086}

datasource:

clickhouse:

database: ${CLICKHOUSE_DB_NAME:test1}

user: ${CLICKHOUSE_USERNAME:default}

password: ${CLICKHOUSE_PASS:}

hosts: ${CLICKHOUSE_HOSTS:clickhouse.host:8123}

fetchSize: ${CLICKHOUSE_FETCH_SIZE:1000}

kafka:

clickhouse:

producer:

property:

key.serializer: org.apache.kafka.common.serialization.ByteArraySerializer

value.serializer: org.apache.kafka.common.serialization.ByteArraySerializer

cluster:

zookeeperHosts: ${ZOOKEEPER_HOSTS:zk-1.dtm.local}

rootPath: ${KAFKA_CLUSTER_ROOTPATH:arenadata/cluster/21}

где,

CLICKHOUSE_DB_NAME– наименование базы данных в ADQM;CLICKHOUSE_HOSTS– имя одно их хостов ADQM;CLICKHOUSE_PASS– пароль пользователя для доступа к ADQM;CLICKHOUSE_USERNAME– имя пользователя для доступа к ADQM;ZOOKEEPER_HOSTS- подключение к Zookeeper ProStore;KAFKA_CLUSTER_ROOTPATH- путь хранения информации о Kafka ProStore в Zookeeper.

2.2.1.4. Настройка kafka-clickhouse-writer

kafka-clickhouse-writer - коннектор, который поддерживает часть функциональности процесса MPP-W (чтение из Kafka и запись данных в базу данных Clickhouse).

Настройка kafka-clickhouse-writer осуществляется путём редактирования файла application.yml, в котором задана логика и порядок работы компонента.

2.2.1.4.1. Пример файла application.yml для kafka-clickhouse-writer

client:

kafka:

consumer:

timeout-checking-period: 1000

response-timeout: 1000

property:

group.id: test_datamart.consumer

auto.offset.reset: earliest

enable.auto.commit: false

env:

name: ${ENV:local}

datamart:

hot-delta-field-name: sys_from

datasource:

clickhouse:

database: ${CLICKHOUSE_DB_NAME:test}

user: ${CLICKHOUSE_USERNAME:}

password: ${CLICKHOUSE_PASS:}

hosts: ${CLICKHOUSE_HOSTS:localhost:8123}

verticle:

worker:

new-data-worker:

poolSize: 20

pool-name: new-data-worker

logging:

level:

io.arenadata.dtm: DEBUG

org.apache.kafka: INFO

где,

CLICKHOUSE_DB_NAME– наименование базы данных в ADQM;CLICKHOUSE_HOSTS– имя одно их хостов ADQM;CLICKHOUSE_PASS– пароль пользователя для доступа к ADQM;CLICKHOUSE_USERNAME– имя пользователя для доступа к ADQM;KAFKA_BOOTSTRAP_SERVERS- подключение к ProStore Kafka.ENV- название окружения.

2.2.2. Настройка СМЭВ QL Сервера

2.2.2.1. Конфигурирование сервера

СМЭВ QL сервер содержит два конфигурационных файла:

credentials.yaml - конфигурирует представление сервера

application.yaml - конфигурирует поведение сервера

Состав настроек credentials.yaml:

version: 1.0.0

system:

mnemonic: smev_ql_mnemonic

instance: smev_ql_instance

2.2.2.2. Язык и синтаксис

2.2.2.2.1. Моделирование

Для моделирования документного слоя данных в спецификации выбран язык разметки YAML.

2.2.2.2.2. Запросы и ответы

Для написания запросов, а также в качестве сериализатора ответов, спецификация определяет использование JSON.

2.2.2.3. Типизация

Фактические типы данных наследуют типы данных JSON (включая NULL):

string;

number;

object;

array;

boolean;

null.

2.2.2.3.1. Типы данных в модели и приведение типов

В описании модели допускается указание фактического типа данных атрибута ресурса вторым элементом массива type. Указание является опциональным, по умолчанию подразумевается неограниченный STRING.

Пример из описания модели:

fields:

id:

name: Идентификатор записи

type:

- number

- SHORT

length: 20

nullable: not NULL

key: PRIMARY

В качестве второго уточняющего типа следует применять типы НСУД:

STRING;

DOUBLE;

FLOAT;

BOOLEAN;

BYTE (не поддерживается на витрине);

BINARY;

BIG_DECIMAL (не поддерживается на витрине);

LONG;

INTEGER;

SHORT;

DATE;

TIME;

TIMESTAMP.

2.2.2.4. Моделирование данных

Модели данных описываются в формате YAML в папке проекта models согласно спецификации СМЭВ QL.

2.2.2.4.1. Структура базовой модели

Базовая модель должна ставиться впереди общего файла моделей, так как от ее алиасов наследуется элементы пользовательских моделей. Описание базовой модели данных в формате YAML имеет следующую структуру:

default_string: &ds

name: Строка

type:

- string

- STRING

length: 0

nullable: NULL

key: NONE

source: NONE

default_number: &dn

name: Число

type:

- integer

- INTEGER

length: 0

nullable: NULL

key: NONE

source: NONE

primary_key: &pk

name: Ключ

type:

- string

- STRING

length: 0

nullable: NULL

key: PRIMAY

source: NONE

base_model: &base_model

default_fields: &default_fields

2.2.2.4.2. Структура модели данных

Каждая модель представляет из себя YAML-файл, который должен быть соединен с базовой моделью для прохождения валидации.

Первый блок модели определяет ее мета-данные и атрибутивный состав.

Мета-данные и поля модели

resources:

# slots — техническое название модели, по нему производятся все связи

- slots: *base_model

# значение name — название модели на русском языке

name: Слоты

# fields — список полей модели

fields:

# список полей может включать перечень полей из default_fields

<<: *default_fields

# поля по-умолчанию наследуются от ds (default_string) из базовой модели

id: *ds

resource_id: *ds

# у поля может быть переопределен source (по-умолчанию у каждого поля источник всей модели)

type: *ds

source:

field: tag_type

age: *ds

source:

field: tag_age

visitTime: *ds

duration: *ds

status: *ds

create_ts: *ds

update_ts: *ds

update_ts: *ds

Второй блок модели описывает связи моделей друг с другом через ключи primary_key и foreign_key.

Ключи могут быть составными (описывается массивом), ключи не обязательно должны быть ключами из БД.

Связи имеют два типа:

belongs_to

has_many (один ко многим)

Связи модели

# Блок connections описывает связи модели (по названию) через явно указываемых два ключа

connections:

belongs_to:

- resource:

primary_key: [ id ]

foreign_key: [ resource_id ]

has_many:

- book:

primary_key: [ id ]

foreign_key: [ slot_id ]

- unaccessible_period:

primary_key: [ resource_id, type ]

foreign_key: [ resource_id, type ]

Блок ограничений и разрешений использования условий поиска.

Связи модели

# Блок conditions описывает ограничения и разрешения на использование условий поиска

conditions:

allowed: [id, name] # если заполнено, то поиск разрешен только по этим полям и полям с ключами

denied: [snils] # если заполнено, то поиск запрещен по этим ключам

always: # наличие условий в блоке always должно ко всем запросам ресурса добавлять эти условия, если указаны в запросе, то перетирать

- region: ["=", "77"]

- blocked: ["=", true]

Блок — extract, описывает названия source из которого нужно извлекать модель и ее таблицу.

Источники модели

extract:

source:

- name: prostore

table: misdm.slots

Источники по условиям

В блоке c указанием источника в модели допускается указание условий его выбора через блок conditions. Блок conditions содержит массив условий применения источника на основании значений полученных в запросе атрибутов:

extract:

source:

- name: prostore1

table: misdm.slots

conditions:

# попадание в промежуток

- range:

field: age

from: 0

to: 2

- eq:

field: color

not: "blue"

- name: prostore2

table: misdm.39slots

conditions:

# ограничения по (не)равенству

- eq:

field: resource_id

is: 1

- name: prostore3

table: misdm.39slots

conditions:

# ограничения по наличию в источнике

- eq:

field: snils

extract:

source: redis

table: default_table

key: resource_hashed_id

algorithm: md5

# select count(*) > 0 from offices.offices where resource_hashed_id = ?

# параметр: md5(snils)

is: true

- name: prostore_default

table: misdm.39slots

conditions:

- fallback: true

2.2.2.4.3. Загрузка

Модели данных считываются, валидируются и загружаются в память из папки models при запуске СМЭВ QL сервера.

По-умолчанию используется версия model, на которую ссылается symlink current, при его отсутствии по-умолчанию считается старшая версия.

Примечание

Модели и версии, начинающиеся с подчеркивания (_) НЕ загружаются, они находятся в стадии проектирования.

2.2.2.4.4. Guard-атрибуты

Для ограничения возможности получения некоторых атрибутов без предварительного предоставления их же (или дополнительных) значения, извлекающим необходимо определить атрибуты-ограничители в блоке guard.

Пример:

fields:

<<: *default_fields

first_name: *ds

last_name:

<<: *ds

guard: [last_name]

snils:

<<: *ds

guard: [last_name first_name snils]

В примере извлечение first_name не ограничивается. Для получения last_name фамилия должна быть передана в блоке conditions, а для получения snils в conditions должны присутствовать фамилия, имя и сам СНИЛС.

2.2.2.5. Запросы

Запросы к серверу выполняют методом POST и содержат в теле JSON-объект, состоящий из обязательных блоков:

Блок Credentials;

Блок Query;

Также пространстве методов server находятся методы, помогающие эксплуатации корректно конфигурировать хранилища данных относительно модели СМЭВ QL.

2.2.2.5.1. Блок Credentials

"credentials":{

"system":{

"mnemonic":"117bed7f-1c07-4079-a446-1161588db4e5",

"instance_id":"ccb4a88f-f44b-43e7-8a97-3e45c8345e90",

"user_id":"5ed38461-0907-486a-930a-7b443482932c"

},

"request":{

"id":"df5a0073-c6be-4d8c-8eb2-9b2f4188a429",

"sub_id":"0cdb59ce-224b-4118-8da1-c5ea08a5d955",

"name":"driver_data",

"purpose_id":"ed1170f1-3caa-4985-aa38-c9c5a190b770",

"audit":"false",

"audit_id":"fc1048fe-323d-4eeb-92df-5710b3d1d100",

"audit_token":"39e47aac-45d2-44c1-8c26-2d9b28b1703b"

},

"signature":{

"digest": null,

"signature": null

}

}

2.2.2.5.2. Блок Query

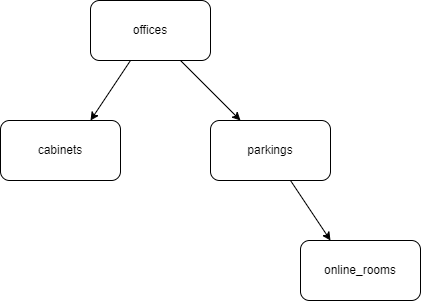

{

"query": {

"office": {

"conditions": {

"phone": "(347) 246-53-00"

},

"attributes": [

"id",

"phone",

"name"

],

"cabinet": {

"conditions": {

"available": true

},

"attributes": [

"number",

"name",

"seats"

],

"online_room": {

"conditions": {

"public": true,

"software": "zoom"

},

"attributes": [

"url"

]

},

"parking": {

"conditions": {

"free": true,

"available": true

},

"attributes": [

"number",

"floor"

]

}

}

}

}

}

2.2.2.5.2.1. Условия фильтрации Conditions

Объединение условий только по and (MVP)

Операции сравнения (op):

= (по умолчанию)

>

>=

<

<=

in

like (на перспективу)

Условия сравнения применимы к численным типам, датам, временам и таймштампам.

Варианты определения условий фильрации:

По равенству

{

"query": {

"office": {

"conditions": {

"phone": "(347) 246-53-00"

}

}

}

}

На основе сравнения, краткая запись

{

"query": {

"office": {

"conditions": {

"area": [">","130"]

}

}

}

}

На основе сравнения, полная запись

{

"query": {

"office": {

"conditions": {

"area": {

"op": ">",

"value": "130"

}

}

}

}

}

Комплексное условие

{

"query": {

"office": {

"conditions": {

"area": [">","130"],

"floor": ["in", [1, 2]]

}

}

}

}

OR (ИЛИ) в условиях

В conditions СМЭВ QL запроса поддерживается возможность указывать логический ИЛИ через зарезервированное слово or.

В блок or необходимо передать массив объектов, содержащих условия в свою очередь объединённые логическим И (AND).

Все условия, находящиеся на одном уровне с or группируются через логическое И (AND), как при обычном СМЭВ QL Запросе.

Пример:

"conditions": {

"lastname": "П",

"middlename": "И",

"birthdate": "2021-11-29 00:00:00",

"or": [

{

"vin": "в1"

},

{

"vin2": "в2",

"model": "bmw"

}

],

"fetch": {

"order": [["id", "ASC"], ["number", "DESC"]], // ASC default

"page": [2, 10] // limit 10 offset 10

}

}

Условия описанного выше запроса (без учета fetch) соберутся в следующую конструкцию:

...

WHERE

(lastname = 'П' AND middlename = 'И' AND birthdate = '2021-11-29 00:00:00')

OR

(vin ='в1')

OR

(vin2='в2' AND model = 'bmw')

...

2.2.2.5.2.2. Сортировка и пагинация

В блоке conditions опционально можно добавить блок fetch, в котором указывать условия сортировки и выбора страниц.

Пример блока:

"conditions": {

"lastname": "П",

"middlename": "И",

"birthdate": "2021-11-29 00:00:00",

"fetch": {

"order": [["id", "ASC"], ["number", "DESC"]], // ASC default

"page": [2, 10] // limit 10 offset 10

}

}

Если порядок сортировки не указан, то применяется ASC.

Если не указаны страницы, то по умолчанию всегда устанавливается первая страница с лимитом, равными параметру default блока pagination в файле конфигураций application.yaml.

Если запрашивается элементов на страницу больше, чем значение max, то должно использоваться дефолтное значение.

pagination:

default: 100 //количество элементов на странице по умолчанию

max: 1000 //максимальное количество элементов на странице

2.2.2.5.3. Эксплуатационные запросы

В пространстве методов server находятся методы, помогающие эксплуатации корректно конфигурировать хранилища данных относительно модели СМЭВ QL.

Метод возврата списка обязательных для создания индексов: GET server/indexes/required

В ответе должен возвращаться JSON с полями, используемыми в связях моделей (connections) и блоке conditions.allowed моделей, если они определены (conditions)

{

"server": {

"mnemonic": "#mnemonic",

"instance": "#instance"

},

"indexes": {

"connections": [{

"source": "#source_name2",

"table": "#table_name2",

"fields": ["#field_name1", "#field_name2"]

},

{

"source": "#source_name2",

"table": "#table_name2",

"fields": ["#field_name1", "#field_name2"]

}

],

"conditions": [{

"source": "#source_name2",

"table": "#table_name2",

"fields": ["#field_name1", "#field_name2"]

},

{

"source": "#source_name2",

"table": "#table_name2",

"fields": ["#field_name1", "#field_name2"]

}

]

}

}

2.2.2.6. Обработка запросов

2.2.2.6.1. Логирование мета-данных

У каждого запроса логируются данные из блока credentials в info и выше.

Формат строчки лога:

{

"level": "info",

"time": "2000-01-01T01:01:01.111Z",

"name": "#{smevql_server_name}.request",

"system": {

"mnemonic": "117bed7f-1c07-4079-a446-1161588db4e5",

"instance_id": "ccb4a88f-f44b-43e7-8a97-3e45c8345e90",

"user_id": "5ed38461-0907-486a-930a-7b443482932c"

},

"request": {

"id": "df5a0073-c6be-4d8c-8eb2-9b2f4188a429",

"sub_id": "0cdb59ce-224b-4118-8da1-c5ea08a5d955",

"name": "driver_data",

"purpose_id": "ed1170f1-3caa-4985-aa38-c9c5a190b770",

"audit": "false",

"audit_id": "fc1048fe-323d-4eeb-92df-5710b3d1d100",

"audit_token": "39e47aac-45d2-44c1-8c26-2d9b28b1703b"

}

}

Для каждого входящего запроса логируется каждый отправленный запрос к источнику:

{

"level": "info",

"time": "2000-01-01T01:01:01.111Z",

"name": "#{smevql_server_name}.request",

"system": {

"mnemonic": "117bed7f-1c07-4079-a446-1161588db4e5",

"instance_id": "ccb4a88f-f44b-43e7-8a97-3e45c8345e90",

"user_id": "5ed38461-0907-486a-930a-7b443482932c"

},

"request": {

"id": "df5a0073-c6be-4d8c-8eb2-9b2f4188a429",

"sub_id": "0cdb59ce-224b-4118-8da1-c5ea08a5d955",

"name": "driver_data",

"purpose_id": "ed1170f1-3caa-4985-aa38-c9c5a190b770",

"audit": "false",

"audit_id": "fc1048fe-323d-4eeb-92df-5710b3d1d100",

"audit_token": "39e47aac-45d2-44c1-8c26-2d9b28b1703b"

},

"source_request": {

"id": "1cdb59ce-224b-4118-8da1-c5ea08a5d955",

"source": "#{source_name}"

}

}

Передача идентификаторов:

source_request.id передается в queryId тела запроса в Простор.

В x-request-id передается склейка {request.id};{request.sub_id};{source_request.id}

Логирование ответа

{

"level": "info",

"time": "2000-01-01T01:01:01.111Z",

"name": "#{smevql_server_name}.response",

"system": {

"mnemonic": "117bed7f-1c07-4079-a446-1161588db4e5",

"instance_id": "ccb4a88f-f44b-43e7-8a97-3e45c8345e90",

"user_id": "5ed38461-0907-486a-930a-7b443482932c"

},

"request": {

"id": "df5a0073-c6be-4d8c-8eb2-9b2f4188a429",

"sub_id": "0cdb59ce-224b-4118-8da1-c5ea08a5d955",

"name": "driver_data",

"purpose_id": "ed1170f1-3caa-4985-aa38-c9c5a190b770",

"audit": "false",

"audit_id": "fc1048fe-323d-4eeb-92df-5710b3d1d100",

"audit_token": "39e47aac-45d2-44c1-8c26-2d9b28b1703b"

},

"source_request": {

"id": "1cdb59ce-224b-4118-8da1-c5ea08a5d955",

"source": "#{source_name}"

},

"response": {

"duration": "1ms",

"code": 200,

"result": "ok"

}

}

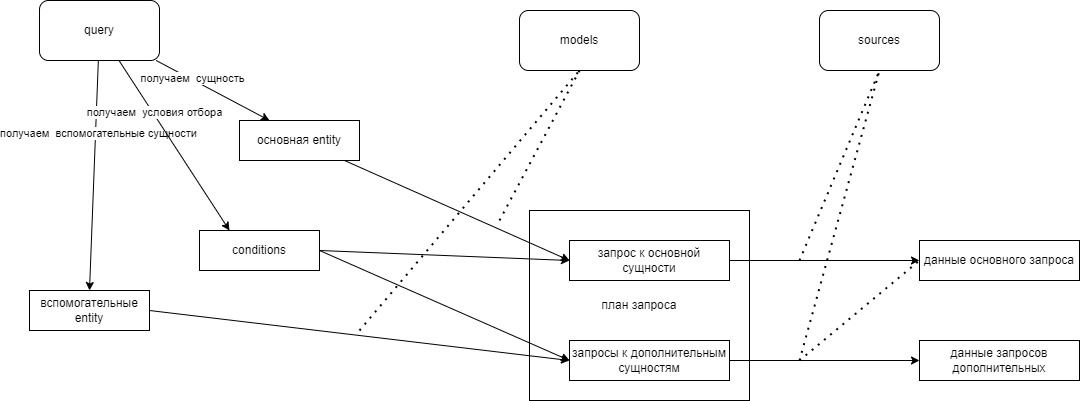

2.2.2.6.2. Построение плана

Входные данные:

загруженные модели, описывающие атрибутный состав сущностей, связи между сущностями и источники;

запрос поступивший к серверу.

Необходимо определить набор запросов и порядок их исполнения SMQEVQL сервером, обеспечить параллельное исполнение независимых запросов.

Вид плана запроса:

plan:

level: 1

- source: prostore1

query: SELECT id, phone, name FROM office WHERE phone = '(347) 246-53-00';

pk: id

alias: offices

level: 2

- source: prostore2

query: SELECT id, number, name, seats FROM cabinet WHERE office_id in (@offices) AND available = 'true';

pk: id

alias: cabinets

- source: prostore1

query: SELECT id, number, floor FROM parking WHERE office_id in (@offices) free = 'true' AND available = 'true';

pk: number, flor

alias: parkings

level: 3

- source: vostok7

query: SELECT url FROM online_room WHERE cabinet_id in (@cabinets) AND public = 'true' AND software = 'zoom';

pk: null

alias: online_rooms

Сначала параллельно выполняются запросы первого уровня, затем запрос второго уровня на основе данных полученных на первом уровне.

Фомирование плана запроса основывается на внешнем объединении данных в сторону основной сущности.

Порядок формирования плана запроса:

на основе query определяется основная запрашиваемая сущность;

на основе query определяются вспомогательные сущности;

на основе query определяются conditions к основной сущности;

на основе query определяются conditions к вспомогательным сущностям;

на первом уровне плана формируется запрос к основной сущности на основе: - запрошенных атрибутов; - данных модели; - условий фильтрации.

Отмечаются поля, составляющие PK.

Первичные ключи, даже отсутствующие в атрибутах запроса к серверу должны быть в запросе к источнику.

формируется запрос к вспомогательным сущностям на основе: - запрошенных атрибутов; - данных модели; - условий фильтрации; - с добавлением фильрации по PK основной или предшествующей сущности.

Первичные ключи, даже отсутствующие в атрибутах запроса к серверу должны быть в запросе к источнику, за исключением терминальных запросов.

План запроса соответсвует иерархии построенной от основной сущности на основе связей (modelconnections).

2.2.2.7. Ответы

Ответы СМЭВ QL сервера представляют из себя объект JSON, схема которого определяется составом запроса.

Например для запроса:

{

"query":{

"people":{

"conditions":{

"age":"<35"

},

"attributes":[

"name",

"phone",

"vsu_code"

],

"military_office":{

"attributes":[

"address"

]

}

}

},

"credentials":{

}

}

Ответ будет следующим:

{

"response":{

"people":[

{

"name":"Иван",

"phone":"+79011001010",

"vsu_code":"1025",

"military_office":[

{

"address":"г.Москва, ул.Угрешко"

}

]

},

{

"name":"Пётр",

"phone":"+79022002020",

"vsu_code":"1026",

"military_office":[

{

"address":"г.Москва, Хилков переулок"

}

]

}

]

},

"credentials":{

}

}

2.2.2.8. Стейт-машина СМЭВ QL

СМЭВ QL содержит встроенную машину состояний для изменения объектов модели внутри витрин данных. Одновременно с этим Стейт машина может, в качестве подтверждения перехода состояния, использовать внешний источник (например ИС Электронной очереди).

Карта состояний и переходов описывается в виде YAML-файла state.yaml располагаемого в папке states/<имя-модели>/<х.х версия модели> инстанса СМЭВ QL Сервера.

Описание формата и правил карты состояний:

model: slot # имя модели

states: # массив состояний объекта

- state: available # название состояния available

attributes: # массив атрибутов, описывающих состояние

- name: status # состояние определятся значением атрибута status

value: AVAILABLE # значение атрибута для описываемого состояния

initial: true

- state: booked

attributes:

- name: status

value: RECORDED

- state: reserved

attributes:

- name: status

value: RESERVED

- state: cancelled

attributes:

- name: status

value: CANCELED

- state: blocked

attributes:

- name: status

value: BLOCKED

events: # список событий изменения состояний, из них создаются методы API

- event: book # создает метод POST /states/slot/book

from: # массив состояний из которых возможен вызов события

- available

- reserved

to: booked # в какое состояние переводится объект после события

hooks: # массив связанных событий

- model: book # после перевода надо вызвать событие init для модели book

event: init

confirm:

source: rmis_rest # названия источника

endpoint: /booking/book

method: post

body: payload # что включать в тело запроса (full|state|conditions|payload|credentials)

accept: # условие принятия

jsonpath: $.status.statusCode

eq: 0 # ожидаем, что statusCode будет равен 0

- event: reserve

from: available

to: reserved

- event: block

from: available

to: blocked

- event: cancel

from:

- available

- reserved

- booked

- blocked

to: cancelled

hooks:

- model: book

event: cancel

При наличии заполненных состояний машины СМЭВ QL Сервер генерирует API c набором HTTP-методов, отвечающих за изменение и просмотр состояний объектов:

GET /states — получить карту переходов

GET /states/<model-name> — получить карту переходов конкретной модели

POST /states/<model-name>/<event-name> — выполнить переход состояний для модели

Запрос выполнения перехода:

POST /states/slot/book

{

"state": {

"conditions": {

"id": "d9e70331-b4c0-4e96-96b6-322ac75e5188" # slot_id

},

"payload": {

"bookId":"82dcac12-0a29-4fff-b9a7-8dfc84f7853d",

"patient_Id":"23453456",

"booking_type":"APPOINTMENT",

"caseNumber":"73367196",

"preliminaryReservation": false,

"email":"email@gmail.com",

"mobilePhone":"89150000102",

"referral_id":"102111",

"cards_id":"102"

}

},

"credentials": {

"system": {

"mnemonic": "117bed7f-1c07-4079-a446-1161588db4e5",

"instance_id": "ccb4a88f-f44b-43e7-8a97-3e45c8345e90",

"user_id": "5ed38461-0907-486a-930a-7b443482932c"

},

"request": {

"id": "df5a0073-c6be-4d8c-8eb2-9b2f4188a429",

"sub_id": "0cdb59ce-224b-4118-8da1-c5ea08a5d955",

"name": "request_name",

"purpose_id": "ed1170f1-3caa-4985-aa38-c9c5a190b770",

"audit": false,

"audit_id": "fc1048fe-323d-4eeb-92df-5710b3d1d100",

"audit_token": false

}

}

}

2.2.2.8.1. Спецификация интерфейса Стейт-машины

openapi: 3.0.0

x-stoplight:

id: 5i2oag6m5eq3v

info:

title: SmevQLStateMachine

version: '1.0'

description: ''

servers:

- url: 'http://localhost:3000'

paths:

/states:

parameters: []

get:

summary: Get models

tags: []

responses:

'200':

description: ''

content:

application/x-yaml:

schema:

$ref: '#/components/schemas/Models'

examples: {}

application/xml:

schema:

type: object

properties: {}

multipart/form-data:

schema:

type: object

properties: {}

text/html:

schema:

type: object

properties: {}

operationId: get-models

description: Retrieve the information of models

'/states/{model}':

parameters:

- schema:

type: string

name: model

in: path

required: true

get:

summary: Get model

tags: []

responses:

'200':

description: Model Found

content:

application/x-yaml:

schema:

$ref: '#/components/schemas/Model'

examples: {}

'400':

description: Bad Request

'404':

description: Model Not Found

operationId: get-model

description: Retrieve the information of model

parameters: []

'/states/{model}/{event}':

post:

summary: State change

operationId: post-state

responses:

'200':

description: State Updated

content:

plain/text:

schema:

type: string

examples: {}

'400':

description: Bad request

'404':

description: Not Found

requestBody:

content:

application/json:

schema:

$ref: '#/components/schemas/StateUpdate'

examples: {}

description: Post the necessary fields for the API to create a new user.

description: Update state

parameters: []

parameters:

- schema:

type: string

name: model

in: path

required: true

- schema:

type: string

name: event

in: path

required: true

components:

schemas:

State:

type: object

x-stoplight:

id: 89f55561cae04

properties:

state:

type: string

attributes:

type: array

minItems: 1

items:

$ref: '#/components/schemas/Attribute'

initial:

type: boolean

Model:

type: object

x-stoplight:

id: b96a73db1e1b2

properties:

model:

type: string

states:

type: array

minItems: 1

items:

$ref: '#/components/schemas/State'

events:

type: array

items:

$ref: '#/components/schemas/Event'

Events:

title: Events

x-stoplight:

id: qdvbkmgs9xkli

type: array

items:

$ref: '#/components/schemas/Event'

States:

$ref: '#/components/schemas/State'

x-stoplight:

id: wab1w6ro30nrl

Event:

title: Event

x-stoplight:

id: sr024y2v7khum

type: object

properties:

event:

type: string

from:

type: string

to:

type: string

Models:

title: ModelSet

x-stoplight:

id: e7de590d788a7

type: array

items:

$ref: '#/components/schemas/ModelInstance'

ModelInstance:

type: object

properties:

model:

type: string

states:

$ref: '#/components/schemas/States'

events:

$ref: '#/components/schemas/Events'

ModelSet:

type: array

items:

$ref: '#/components/schemas/Model'

Attribute:

title: Attribute

x-stoplight:

id: 3kiqu047734tc

type: object

properties:

name:

type: string

value:

type: string

description: ''

StateUpdate:

title: StateUpdate

x-stoplight:

id: 2iyfifo0q1dt2

type: object

properties:

state:

type: object

properties:

conditions:

type: object

payload:

type: object

credentials:

type: object

properties:

system:

type: object

properties:

mnemonic:

type: string

instance_id:

type: string

user_id:

type: string

request:

type: object

properties:

id:

type: string

format: uuid

sub_id:

type: string

format: uuid

name:

type: string

purpose_id:

type: string

format: uuid

audit:

type: boolean

audit_id:

type: string

format: uuid

audit_token:

type: string

Пример реализации: Спецификация интерфейса Стейт-машины РМИС (OpenAPI)

openapi: 3.0.0

x-stoplight:

id: 5i2oag6m5eq3v

info:

title: SmevQLStateMachine

version: '1.0'

description: ''

servers:

- url: 'http://localhost:3000'

paths:

/states:

parameters: []

get:

summary: Get models

tags: []

responses:

'200':

description: ''

content:

application/x-yaml:

schema:

$ref: '#/components/schemas/Models'

examples: {}

application/xml:

schema:

type: object

properties: {}

multipart/form-data:

schema:

type: object

properties: {}

text/html:

schema:

type: object

properties: {}

operationId: get-models

description: Retrieve the information of models

'/states/{model}':

parameters:

- schema:

type: string

name: model

in: path

required: true

get:

summary: Get model

tags: []

responses:

'200':

description: Model Found

content:

application/x-yaml:

schema:

$ref: '#/components/schemas/Model'

examples: {}

'400':

description: Bad Request

'404':

description: Model Not Found

operationId: get-model

description: Retrieve the information of model

parameters: []

'/states/{model}/{event}':

post:

summary: State change

operationId: post-state

responses:

'200':

description: State Updated

content:

plain/text:

schema:

type: string

examples: {}

'400':

description: Bad request

'404':

description: Not Found

requestBody:

content:

application/json:

schema:

$ref: '#/components/schemas/StateUpdate'

examples: {}

description: Post the necessary fields for the API to create a new user.

description: Update state

parameters: []

parameters:

- schema:

type: string

name: model

in: path

required: true

- schema:

type: string

name: event

in: path

required: true

components:

schemas:

State:

type: object

x-stoplight:

id: 89f55561cae04

properties:

state:

type: string

attributes:

type: array

minItems: 1

items:

$ref: '#/components/schemas/Attribute'

initial:

type: boolean

Model:

type: object

x-stoplight:

id: b96a73db1e1b2

properties:

model:

type: string

states:

type: array

minItems: 1

items:

$ref: '#/components/schemas/State'

events:

type: array

items:

$ref: '#/components/schemas/Event'

Events:

title: Events

x-stoplight:

id: qdvbkmgs9xkli

type: array

items:

$ref: '#/components/schemas/Event'

States:

$ref: '#/components/schemas/State'

x-stoplight:

id: wab1w6ro30nrl

Event:

title: Event

x-stoplight:

id: sr024y2v7khum

type: object

properties:

event:

type: string

from:

type: string

to:

type: string

Models:

title: ModelSet

x-stoplight:

id: e7de590d788a7

type: array

items:

$ref: '#/components/schemas/ModelInstance'

ModelInstance:

type: object

properties:

model:

type: string

states:

$ref: '#/components/schemas/States'

events:

$ref: '#/components/schemas/Events'

ModelSet:

type: array

items:

$ref: '#/components/schemas/Model'

Attribute:

title: Attribute

x-stoplight:

id: 3kiqu047734tc

type: object

properties:

name:

type: string

value:

type: string

description: ''

StateUpdate:

title: StateUpdate

x-stoplight:

id: 2iyfifo0q1dt2

type: object

properties:

state:

type: object

properties:

conditions:

type: object

properties:

id:

type: string

format: uuid

payload:

type: object

properties:

book_id:

type: string

format: uuid

patient_id:

type: string

booking_type:

type: string

case_number:

type: string

preliminary_reservation:

type: boolean

email:

type: string

mobile_phone:

type: string

referral_id:

type: string

cards_id:

type: string

credentials:

type: object

properties:

system:

type: object

properties:

mnemonic:

type: string

instance_id:

type: string

user_id:

type: string

request:

type: object

properties:

id:

type: string

format: uuid

sub_id:

type: string

format: uuid

name:

type: string

purpose_id:

type: string

format: uuid

audit:

type: boolean

audit_id:

type: string

format: uuid

audit_token:

type: string

2.2.2.8.1.1. Выполнение операций обновления данных в витрине

Инсерты в витрину выполняются в порядке поступления запросов.

Каждый экземпляр СМЭВ QL сервера ведет нарастающий счетчик инсертов.

Каждый экземпляр СМЭВ QL сервера создает один поток управления дельтами, который выполняет:

Периодически (период конфигурируемая величина, по умолчанию 60 сек) проверяет значение счетчика числа инсертов, если значение счетчика более 0

Выполняет открытие и закрытие дельты с флагом immediate, ошибки открытия и закрытия дельты игнорируются. Попытка закрытия дельты выполняется независимо от успешности открытия дельты.

Обнуляет значение счетчика.

Периодически (период конфигурируемая величина, по умолчанию 30 мин)

Выполняет открытие и закрытие дельты с флагом immediate, ошибки открытия и закрытия дельты игнорируются. Попытка закрытия дельты выполняется независимо от успешности открытия дельты.

Чтение данных сервером СМЭВQL выполняется с применением AS OF <maxLong>.

2.2.2.8.1.2. Обновление объектов через Стейт-машину

Через Стейт-машину можно обновлять записи в витрине. Для этого при конфигурировании карты состояний необходимо

задать значение у event updatable: true.

При этом если требуется дать возможность обновлять только часть

атрибутов, то ограничить этот список можно перечислив атрибуты в массиве updatable_attributes.

- event: reserve

from: available

to: reserved

updatable: true // по умолчанию false для всех, кроме init, возможность изменять запись при переводе статуса

updatable_attributes: [] // массив атрибутов, которые можно обновлять, пустой — можно все

Данные для обновления будут браться из блока payload запроса на смену состояния.

Для события init такое конфигурирование не требуется - по умолчанию обновления разрешены для всех атрибутов из payload.

2.2.2.9. Ошибки

Ошибки выводятся в блоке response:

{

"response": {

"errors": [

{

"error": "Запрещен вывод атрибутов без переданного guard",

"code": "401"

}

]

},

"credentials": {

}

}

2.2.2.9.1. Базовые ошибки СМЭВ Ql

1ХХ Ошибки разбора запроса

101 Запрос не должен называться „errors“ — Неправильное название запроса „errors“

2ХХ Ошибки модели

201 Неизвестный атрибут — У ресурса не найден атрибут с соотв. именем

202 Неизвестный ресурс — Ресурс с соотв. именем не зарегистрирован в модели данных

203 Неизвестная связь — Не найдена связь между двумя ресурсами

204 Неправильная связь — Размеры ключей не соответствуют для соединения одного ресурса с другим

3ХХ Ошибки источников

301 Неизвестный источник — Не найдено описание источника данных с соотв. именем

302 Неизвестный адаптер — Не найден адаптер с соотв. именем

4ХХ Ошибки доступов и ограничений

401 Запрещен вывод атрибутов без переданного guard — Среди запрашиваемых атрибутов есть атрибут с невыполненными ограничениями в блоке guard (не переданы в запросе атрибуты из guard)

402 Недостаточно атрибутов для выбора источника — Среди атрибутов фильтрации нет атрибутов, необходимых для выбора источника

403 Запрещенные атрибуты для поиска — Среди атрибутов фильтрации есть атрибуты, указанные в блоке denied модели

404 Атрибуты для поиска не разрешены — Среди атрибутов фильтрации есть атрибуты, которые не указаны в разрешающем блоке allowed модели

405 Попытка переопределения фиксированных условий поиска — Среди атрибутов фильтрации есть атрибуты, которые пытаются переопределить фиксированные ограничения поиска в блоке always модели

9ХХ Прочие ошибки

901 Непредвиденная ошибка — Непредвиденная ошибка

2.2.3. Настройка СМЭВ3-адаптера

2.2.3.1. Конфигурация СМЭВ3-адаптер (application.yml)

Файл application.yml – основной конфигурационный файл CМЭВ3-адаптера,

в котором задана логика и порядок работы адаптера: получение входящих

запросов, их обработка, а также настройка подключения к СМЭВ и FTP-серверу СМЭВ3, к Prostore через

JDBC-драйвер, BLOB-адаптер, настройка алгоритма формирования и проверки электронной подписи(ЭП) и т.д.

2.2.3.2. Пример файла application.yml

vertx:

#Настройки вертикса

#тут можно указать все настройки из документации для vertx

props:

# метрики

metricsOptions:

enabled: true

# тип метрик, например prometheusOptions | jmxMetricsOptions

prometheusOptions:

enabled: true

startEmbeddedServer: true

embeddedServerOptions:

#порт для сервера с метриками

port: 9033

web-client:

max-pool-size: 20

spring:

liquibase:

enabled: false

main:

allow-bean-definition-overriding: true

smev:

#url смэва

endpointUrl: http://localhost:7979/api/v1/soap/

keystoreType: "DUMMY"

keystoreFile: x

keystorePass: x

privateKeyAlias: x

privateKeyPass: x

certificateAlias: x

signatureURI: "http://www.w3.org/2001/04/xmldsig-more#dummy"

# алгоритм подписи

signatureAlgorithm: "DUMMY"

#метод подписи

digestMethod: "http://www.w3.org/2001/04/xmldsig-more#dummy"

#версия схемы смев

#availiabe 1.2 and 1.3

version: 1.3

#верификация входящих сообщений

incomingVerificationEnabled: false

#подпись исходящих сообщений

outgoingSigningEnabled: false

#таймаут отправки сообщения в смев

timeout: 30000

#время между попытками перепосылки в смев

retry-timeout: 30000

#максимальный размер очереди, ожидающей отправки сообщений

webMaxWaitQueueSize: -1

#пул коннектов

webMaxPoolSize: 20

receiver:

# количество вертиклов

instances: 1

receiver-property:

-

#селектор из смэв

selector:

namespace: a

root-element-name: b

#пебл шаблон, который будет обрабатываться для определенного selector

template: smev3-adapter/templates/smev.xml.peb

#задержка между запросами, в случае если очередб пуста

idle-delay: PT1m

# файл, который будет отправлен в случае ошибки

fallback-response: smev3-adapter/templates/fallback.xml

-

idle-delay: PT1m

selector:

namespace: urn://x-artefacts-testperson/1.0

root-element-name: TestPersonRequest

template: smev3-adapter/templates/smev.xml.peb

prostore-rest-client:

# Признак использования rest-api для взаимодействия с простором. Если false - будет использоваться jdbc драйвер

enabled: ${PS_REST_CLIENT_ENABLED:true}

host: ${PS_HOST:localhost}

port: ${PS_PORT:9195}

http:

max-pool-size: ${PS_MAX_POOL_SIZE:8}

default-schema: demo_view

datasource:

pebble-db:

# url базы данных простора

jdbcUrl: 'jdbc:prostore://t5-prostore-01.ru-central1.internal:9195/demo_view'

driverClassName: 'ru.datamart.prostore.jdbc.Driver'

environment:

name: ${ENVIRONMENT_NAME:test}

zookeeper:

connection-string: ${ZOOKEEPER_DS_ADDRESS:t5-adsp-01.ru-central1.internal}

retryPolicy:

baseSleepTime: 1000

maxRetries: 3

maxSleepTime: 3000

chroot: ${ZOOKEEPER_DS_CHROOT:/adapter}

migration:

zk-enabled: ${MIGRATION_ZK_ENABLE:false}

paramstorage:

base-path: '/smev/paramstorage'

deltastorage:

base-path: '/smev/deltastorage'

sign:

#алгоритм подписи файла

digest-algorithm: 1.2.643.7.1.1.2.2

blob:

# настройки подключения к BLOB адаптеру

blob-source:

host: 'localhost'

port: 8080

path:

ftp-destination:

#хост фтп смева

host: localhost

#порт фтп смева

port: 21

#корневой каталог

#path: aaa/bbb/ccc

#пользователь

user: user

#пароль

password: 123

rest:

#вкл/выкл

enabled: false

#порт на котором будет запущена рестовая ручка

port: 8080

# путь get запроса

get: /le

#путь post запроса

post: /le

#обрабатываемый шаблон

template: smev3-adapter/templates/smev.xml.peb

#рассылка смев

scheduler:

#вкл/выкл

enabled: false

#интервал между запусками

interval: PT30s

#обрабатываемый шаблон

template: smev3-adapter/templates/pfr-delta.peb

pool:

#корутин пул для обработки смев шаблонов

reader-executor: 20

#корутин пул для обработки шедулера

schedule-executor: 1

logExecutor: 20

logging:

level:

root: info

ru:

rtlabs:

smev:

logging: trace

request-response:

smev-request: true

smev-response: true

backup:

zk-path: ${SMEV3_BACKUP_ZK_PATH:/${environment.name}/smev3-adapter}

commandTopic: ${BACKUP_COMMAND_TOPIC:adapter.command}

adapterCommandBroadcast: ${S3A_ADAPTER_COMMAND_BROADCAST_TOPIC:adapter.command.broadcast}

backupTopic: ${BACKUP_TOPIC:adapter.backup}

statusTopic: ${STATUS_TOPIC:adapter.status}

timeout: ${BACKUP_TIMEOUT:PT180s}

kafka:

consumer:

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:localhost:9092}

group.id: ${SMEV3_BACKUP_GROUP_ID:smev3-adapter_adapter_command}

auto.offset.reset: latest

producer:

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:localhost:9092}

# Параметры подключения к сервису печатных форм. Указывается при использовании функции toSpf

spf:

host: ${SPF_HOST:localhost}

port: ${SPF_PORT:8080}

# Дополнительные параметры. Указываются ключ-значения сертификатов, необходимых для сервиса ПФ

params: {}

2.2.3.3. Параметры конфигурации

Настройка конфигурации CМЭВ3-адаптера осуществляется путем редактирования параметров настроек в файле application.yml.

Пример конфигурации файла application.yml для CМЭВ3-адаптера см. в разделе Пример файла application.yml Руководства администратора.

Обязательными параметрами для настройки CМЭВ3-адаптера являются секции: smev, receiver, datasource. Остальные параметры следует оставить без изменения и настраивать только для решения определенных бизнес-задач.

Pebble-шаблоны для настройки задаются в секциях: receiver-property, rest и scheduler.

Для каждого вида сведений, предоставляемых Витриной, следует создать отдельное сопоставление receiver и установить значения receiver-property. Остальные параметры следует оставить без изменения.

В файле конфигурации могут быть настроены следующие секции:

vertx– настройка параметров фреймворка Vert.x (подробнее на сайте разработчиков: https://vertx.io/docs/).spring– подключение к фреймворку spring boot (используется для разработки);smev– настройки подключения к CМЭВ3-адаптеру;receiver- настройка взаимодействия СМЭВ-запросов с Peblle-шаблонами (для каждогоreceiverможно настроить количествоinstance);prostore-api-client- блок параметров конфигурирования взаимодействия с ProStore. Если false - будет использоваться JDBC-драйвер;datasource– параметры подключения к ProStore;environment- настройки окружения;zookeeper– параметры подключения к Zookeeper;migration– настройка параметров миграции сервисной базы данных **CМЭВ3-адаптера**` в базу данных Zookeeper;paramstorage– указывается корневой путь хранилища параметров;deltastorage– указывается корневой путь хранилища дельт;sign- настройка формирования и проверки электронной подписи(ЭП) в SOAP-пакетах СМЭВ3.blob- интеграция с BLOB-адаптер;rest- настройки подключения для возможности выполнения rest-запросов к СМЭВ3-адаптеру и получения ответов на них;scheduler- настройка планировщика заданий (запуск дельт по расписанию);pool- размер прерываемого кода;logging– настраивается логирование работы модуля;backup- настройки бекапирования;spf- Параметры подключения к сервису печатных форм. Указывается при использовании функции toSpf.

2.2.3.3.1. Секция vertx

Секция vertx предназначена для настройки параметров фреймворка Vert.x (подробнее на сайте разработчиков: https://vertx.io/docs/). Для включения сбора метрик используйте следующий код:

vertx:

#Настройки вертикса

#тут можно указать все настройки из документации для vertx

props:

# метрики

metricsOptions:

enabled: true

# тип метрик, например prometheusOptions | jmxMetricsOptions

prometheusOptions:

enabled: true

startEmbeddedServer: true

embeddedServerOptions:

#порт для сервера с метриками

port: 9033

web-client:

max-pool-size: 20

2.2.3.3.2. Секция spring

Секция spring подключение к фреймворку spring boot (используется для разработки).

Например:

spring:

liquibase:

enabled: false

main:

allow-bean-definition-overriding: true

2.2.3.3.3. Секция smev

Секция smev отвечает за настройки подключения к СМЭВ3.

Например:

smev:

endpointUrl: http://127.0.0.1:7979/api/v1/soap/

keystoreType: "DUMMY"

keystoreFile: x

keystorePass: x

privateKeyAlias: x

privateKeyPass: x

certificateAlias: x

signatureURI: "http://www.w3.org/2001/04/xmldsig-more#dummy"

signatureAlgorithm: "DUMMY"

digestMethod: "http://www.w3.org/2001/04/xmldsig-more#dummy"

incomingVerificationEnabled: false

outgoingSigningEnabled: true

#таймаут отправки сообщения в смев

timeout: 30000

#время между попытками перепосылки в смев

retry-timeout: 30000

#максимальный размер очереди, ожидающей отправки сообщений

webMaxWaitQueueSize: -1

#пул коннектов

webMaxPoolSize: 20

В случае, когда СМЭВ3 не отвечает на запрос, в новой версии СМЭВ3-адаптера (секция smev), добавлена возможность, которая позволяет задать время ожидания ответа (timeout) перед повторной отправкой запроса к СМЭВ3:

timeout- таймаут отправки сообщения в СМЭВ3;retry-timeout- время между повторной попыткой отправки запроса в СМЭВ3;webMaxWaitQueueSize- максимальный размер очереди, ожидающей отправки сообщений;webMaxPoolSize- пул коннектов.

Примечание

Для удобного отслеживания в лог-файлах всех запросов/ответов к СМЭВ3 в рамках одной бизнес-операции, в файл logback-json.xml добавлен параметр ReqMessageID. При обработке ошибки от СМЭВ3, в лог-файл добавляется описание ошибки и код ошибки СМЭВ3 (в том случае, если СМЭВ3 вернул данный код в блоке description).

2.2.3.3.4. Секция receiver

Секция receiver предназначена для настройки параметров взаимодействия СМЭВ-запросов с peblle-шаблонами.

Например:

receiver:

receiver-property:

-

selector:

namespace: a

root-element-name: b

template: templates/smev.xml.peb

idle-delay: PT1m

fallback-response: templates/fallback.xml

-

selector:

namespace: urn://x-artefacts-testperson/1.0

root-element-name: TestPersonRequest

template: templates/smev.xml.peb

idle-delay: PT1s

Параметры настроек

namespace- пространство имен в XML.root-element-name- имя корневого элемента запроса обрабатываемого ВС (как указано в заявке на регистрацию ВС);templateИмя файла, содержащего pebble-шаблон обработки запросов для данного ВС;idle-delay- периодичность опроса очереди СМЭВ3 для получения новых запросов (в формате ISO 8601).mtom-xop-postfix- включение бинарных данных посредством ссылкиxop, например:

<xop:Include xmlns:xop="http://www.w3.org/2004/08/xop/include" ref="cid:320038b2-0485-4658-89cc-980b7c8b5193@smev_client"/>

Пример файла smev.xml.peb

Пример файла fallback.xml

Ответ при ошибке обработки запроса.

2.2.3.3.5. Секция prostore-rest-client

В секции prostore-rest-client реализован блок параметров конфигурирования взаимодействия с ProStore. Параметр prostore-rest-client.enabled со значением

false позволяет переключить исполнение запросов через JDBC-драйвер.

Например:

prostore-rest-client:

# Признак использования rest-api для взаимодействия с простором. Если false - будет использоваться jdbc драйвер

enabled: true

host: ${PS_HOST:t5-prostore-01.ru-central1.internal}

port: ${PS_PORT:9195}

http:

max-pool-size: ${PS_MAX_POOL_SIZE:8}

Параметры настроек

host- адрес Prostore, напримерPS_HOST:t5-prostore-01.ru-central1.internal;port- порт Prostore, напримерPS_PORT:9195;max-pool-size- максимальное число подключений к Prostore, напримерPS_MAX_POOL_SIZE:8.

2.2.3.3.6. Секция datasource

Секция datasource предназначена для настройки параметров подключения к ProStore.

Например:

datasource:

pebble-db:

# url базы данных простора

jdbcUrl: 'jdbc:prostore://t5-prostore-01.ru-central1.internal:9195/demo_view'

driverClassName: 'ru.datamart.prostore.jdbc.Driver'

Параметры настроек

jdbcUrl– строка подключения к сервисной БД СМЭВ3-адаптера по JDBC в формате:jdbcUrl: jdbc:postgresql://127.0.0.1:5432/smev3_connector;

2.2.3.3.7. Секция environment

В секции environment указывается среда разработки (dev, test, stable, prod)

Например:

environment:

name: ${ENVIRONMENT_NAME:test}

Параметры настроек

name- Название окружения, напримерENVIRONMENT_NAME:test.

2.2.3.3.8. Секция zookeeper

Секция zookeeper предназначена для настройки параметров подключения к Zookeeper.

Например:

zookeeper:

connection-string: ${ZOOKEEPER_DS_ADDRESS:t5-adsp-01.ru-central1.internal}

retryPolicy:

baseSleepTime: 1000

maxRetries: 3

maxSleepTime: 3000

chroot: ${ZOOKEEPER_DS_CHROOT:/adapter}

Параметры настроек

connect-string- адреса серверов для подключения к Zookeeper (разделитель -,);baseSleepTime- начальное значение таймаута ожидания при повторных запросах;maxRetries- максимальное количество повторных запросов;maxSleepTime- максимальное значение таймаута ожидания при повторных запросах.

2.2.3.3.9. Секция migration

Секция migration реализована настройка миграции зукипера для задачи бекапирования.

Например:

migration:

zk-enabled: ${MIGRATION_ZK_ENABLE:false}

Параметры настроек

enabled- подключение миграции, например{MIGRATION_ENABLE:false}.

2.2.3.3.10. Секция paramstorage

В секции paramstorage указывается корневой путь до сервера Zookeeper для механизма параметров (ключ-значение).

Например:

paramstorage:

base-path: '/smev/paramstorage'

2.2.3.3.11. Секция deltastorage

В секции deltastorage указывается корневой путь до сервера Zookeeper для механизма дельт.

Например:

deltastorage:

base-path: '/smev/deltastorage'

2.2.3.3.12. Секция sign

Секция sign предназначена для формирования и проверки электронной подписи(ЭП) в SOAP-пакетах СМЭВ3.

Например:

sign:

digest-algorithm: 1.2.643.7.1.1.2.2

digest-algorithm- алгоритм ключа проверки электронной подписи.

2.2.3.3.13. Секция blob

Секция blob предназначена для настройки взаимодействия модуля СМЭВ3-адаптер с:

BLOB-адаптером для считывания BLOB-полей (см. Взаимодействие через СМЭВ3-адаптер);

FTP-сервером СМЭВ3, на который модуль СМЭВ3-адаптер выгружает содержимое BLOB-полей и/или большие табличные данные.

Например:

blob:

# настройки подключения к BLOB адаптеру

blob-source:

host: 'localhost'

port: 8080

path:

ftp-destination:

#хост фтп смева

host: localhost

#порт фтп смева

port: 21

#корневой каталог

#path: aaa/bbb/ccc

#пользователь

user: user

#пароль

password: 123

blob-source- настройка подключения к BLOB-адаптеру;ftp-destination- настройка подключения к FTP-серверу СМЭВ3.

2.2.3.3.14. Секция rest

Секция rest предназначена для настройки возможности выполнения REST-запросов к СМЭВ3-адаптеру и получения ответов на них.

Например:

rest:

#вкл/выкл

enabled: false

#порт на котором будет запущена рестовая ручка

port: 8080

# путь get запроса

get: /le

#путь post запроса

post: /le

#обрабатываемый шаблон

template: smev3-adapter/templates/smev.xml.peb

2.2.3.3.15. Секция scheduler

Секция scheduler предназначена для настройки планировщика заданий в случае, если планируется использовать механизм отправки дельт по расписанию.

Например:

scheduler:

enabled: true

interval: PT30s

template: templates/pfr-delta.peb

Параметры настроек

enabled- включение планировщика заданий;interval- интервал между отправкой дельт;template- путь к Pebble-шаблону;

2.2.3.3.16. Секция pool

В секции pool указывается размер прерываемого кода.

Например:

pool:

reader-executor: 20

schedule-executor: 1

restExecutor: 1

logExecutor: 20

2.2.3.3.17. Секция logging

В секции logging настраивается логирование работы модуля.

Например:

logging:

request-response:

smev-request: false

smev-response: false

Параметры настроек

smev-request- логирование запросов;smev-response- логирование ответов.

2.2.3.3.18. Секция backup

Секция backup предназначена для настроек бекапирования модуля.

Например:

backup:

zk-path: ${SMEV3_BACKUP_ZK_PATH:/${environment.name}/smev3-adapter}

commandTopic: ${BACKUP_COMMAND_TOPIC:adapter.command}

adapterCommandBroadcast: ${S3A_ADAPTER_COMMAND_BROADCAST_TOPIC:adapter.command.broadcast}

backupTopic: ${BACKUP_TOPIC:adapter.backup}

statusTopic: ${STATUS_TOPIC:adapter.status}

timeout: ${BACKUP_TIMEOUT:PT180s}

kafka:

consumer:

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:localhost:9092}

group.id: ${SMEV3_BACKUP_GROUP_ID:smev3-adapter_adapter_command}

auto.offset.reset: latest

producer:

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:localhost:9092}

Параметры настроек

zk-path- путь к корневой ноде zookeeper для бэкапирования, например{COUNTER_BACKUP_ZK_PATH:/${environment.name}/counter-provider/counters};commandTopic- топик команд бэкапирования, например:{BACKUP_COMMAND_TOPIC:adapter.command};backupTopic- топик для отправки забэкапированных данных, например:{BACKUP_TOPIC:adapter.backup};statusTopic- топик для отправки статусов бэкапирования, например:{STATUS_TOPIC:adapter.status}.

2.2.3.3.19. Секция spf

В секции spf указываются параметры подключения к сервису печатных форм. Указывается при использовании функции toSpf.

Например:

spf:

host: ${SPF_HOST:localhost}

port: ${SPF_PORT:8080}

# Дополнительные параметры. Указываются ключ-значения сертификатов, необходимых для сервиса ПФ

params: {}

Параметры настроек

host- адрес подключения, например{SPF_HOST:localhost};port- порт подключения, например:{SPF_PORT:8080};params- Дополнительные параметры. Указываются ключ-значения сертификатов, необходимых для сервиса ПФ.

2.2.4. Настройка CSV-Uploader

2.2.4.1. Конфигурация CSV-uploader (application.yml)

Файл application.yml – основной конфигурационный файл CSV-uploader, в котором задана логика и порядок работы загрузчика, а также другие настройки необходимые для корректной работы адаптера.

2.2.4.1.1. Пример файла application.yml

# Kafka Prostore

.kafkaUrl: &kafkaUrl ${KAFKA_BOOTSTRAP_SERVERS:localhost:9092}

http-server:

# Порт для старта веб сервера

port: ${HTTP_PORT:8080}

# Включить веб-сервер

enabled: ${HTTP_ENABLED:true}

send:

# Размер отправляемой порции данных

chunk-row-count: ${CHUNK_ROW_COUNT:1000}

# Размер буфера на чтение файла

file-buffer-size: ${FILE_BUFFER_SIZE:1048576}

# Количество Job на чтение

read-job-count: ${READ_JOB_COUNT:4}

# Размер Channel для сериализации

serialize-channel-size: ${SERIALIZE_CHANNEL_SIZE:20}

# Количество Job на сериализацию

serialize-job-count: ${SERIALIZE_JOB_COUNT:4}

# Размер Job на отправку

send-channel-size: ${SEND_CHANNEL_SIZE:20}

# Количество Job на отправку

send-job-count: ${SEND_JOB_COUNT:4}

# Ограничение на размер оправляемого файла (мегабайты)

file-size-restriction: ${SEND_FILE_SIZE_RESTRICTION:1024}

logging.level:

root: info

ru.itone: debug

environment:

# Название окружения

name: ${ENVIRONMENT_NAME:test}

# Папка для ошибочных файлов

error-folder: ${ENVIRONMENT_ERROR_FOLDER:error}

zookeeper:

# Адрес сервера zookeeper

connection-string: ${ZK_CONNECTION:localhost}

# Таймаут сессии

session-timeout-ms: ${ZK_SESSION_TIMEOUT_MS:30000}

# Таймаут подключения

connection-timeout-ms: ${ZK_CONNECTION_TIMEOUT_MS:86400000}

chroot: ${ZOOKEEPER_DS_CHROOT:/adapter}

migration:

enabled: ${MIGRATION_ENABLE:false}

prostore-rest-client:

# Признак использования rest-api для взаимодействия с простором. Если false - будет использоваться jdbc драйвер

enabled: ${PS_REST_CLIENT_ENABLED:true}

host: ${PS_HOST:localhost}

port: ${PS_PORT:9195}

http:

max-pool-size: ${PS_MAX_POOL_SIZE:8}

prostore:

# subprotocol для jdbc

subprotocol: ${PS_SUBPROTOCOL:prostore}

# Драйвер для подключения к простору

driver: ${PS_DRIVER:ru.datamart.prostore.jdbc.Driver}

# Подключение к Prostore

host: ${PS_HOST:localhost}

# Prostore порт

port: ${PS_PORT:9195}

# Prostore начальный размер пула ру

initialPoolSize: ${PS_INITIAL_POOL_SIZE:5}

# Prostore максимальный размер пула

maxPoolSize: ${PS_MAX_POOL_SIZE:8}

additional-props:

key: value

zookeeper:

# Адрес сервера zookeeper для загрузки данных в простор

connection-string: ${ZK_PROSTORE_CONNECTION:locahost:2181}

validation:

enable: ${VALIDATION_ENABLE:true}

rest-uploader-url: ${REST_UPLOADER_URL:http://localhost:8081}

# обязательность использования ФЛК

mandator: ${VALIDATION_MANDATOR:false}

upload:

# требуется токен для аутентификации на rest-uploader

jwt-auth: ${JWT_AUTH:false}

kafka:

create-topic:

# Количество партиций на загрузку через EDML

num-partitions: ${EDML_UPLOAD_NUM_PARTITIONS:1}

# Фактор репликации при создании топика

replication-factor: ${EDML_UPLOAD_REPLICATION_FACTOR:1}

topic:

# Топик для журналирования

journal-log: journal.log

flk-log: flk.log

consumer:

# Количество партиций на выгрузку через EDML

num-partitions: ${EDML_DOWNLOAD_NUM_PARTITIONS:1}

property:

bootstrap.servers: *kafkaUrl

group.id: csv-uploader

auto.offset.reset: earliest

enable.auto.commit: true

producer:

property:

bootstrap.servers: *kafkaUrl

csv-parser:

separator: ${CSV_PARSER_SEPARATOR:;}

quote-char: ${CSV_PARSER_QUOTE_CHAR:"}

escape-char: ${CSV_PARSER_ESCAPE_CHAR:'}

field-as-null: ${CSV_PARSER_FIELD_AS_NULL:EMPTY_SEPARATORS}

metrics:

port: ${METRICS_PORT:9837}

backup:

zk-path: ${CSV_UPLOADER_BACKUP_ZK_PATH:/${environment.name}/csv-uploader/config}

commandTopic: ${BACKUP_COMMAND_TOPIC:adapter.command}

backupTopic: ${BACKUP_TOPIC:adapter.backup}

statusTopic: ${STATUS_TOPIC:adapter.status}

kafka:

consumer:

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:localhost}

group.id: ${CSV_UPLOADER_BACKUP_GROUP_ID:csv_uploader_adapter_command}

auto.offset.reset: latest

producer:

property:

bootstrap.servers: ${KAFKA_BOOTSTRAP_SERVERS:localhost}

jet-connector:

use: ${JET_CONNECTOR_USE:false}

kafka-consumer-group-name: ${JET_CONNECTOR_GROUP_NAME:csv-uploader}

kafka-poll-duration-ms: ${JET_POLL_DURATION:200}

kafka-poll-buffer-size: ${JET_POLL_BUFFER:2000}

db-records-buffer-size: ${JET_DB_RECORDS_BUFFER:2000}

2.2.4.2. Параметры конфигурации

Настройка конфигурации CSV-uploader осуществляется путем редактирования параметров настроек в файле application.yml. Некоторые настройки доступны для редактирования через пользовательский интерфейс модуля, например, Настройка отображения количества записей в Журнале операций и Запуск по расписанию.

Пример конфигурации файла application.yml для CSV-uploader см. в разделе Пример файла application.yml Руководства администратора.

В файле конфигурации CSV-uploader могут быть настроены следующие секции:

kafkaUrl- URL для доступа к Kafka;http-server- настройки порта подключения;send- настройка отправки файлов;logging.level- настройка сохранения лог-файла;environment- определяет значение среды разработки;zookeeper- настройка подключения Zookeeper;migration- настройка миграции зукипера для задачи бекапирования;prostore-rest-client- блок параметров конфигурирования взаимодействия с ProStore. Если false - будет использоваться JDBC-драйвер;prostore- настройка подключения к ProStore;validation- включение/выключение механизма валидации загрузки с помощью rest-uploader сервиса;upload- требование токена для аутентификации на rest-uploader;kafka- настройка подключения к шине данных Apache Kafka;csv-parser- настройка парсинга CSV;metrics- настройка получения метрик;backup- настройка бэкапирования модуля;jet-connector- подготовлен для оптимизации задержек записи.

2.2.4.2.1. Секция kafkaUrl

В секция kafkaUrl указывается URL-адрес для доступа к Apache Kafka (ProStore).

Например:

.kafkaUrl: &kafkaUrl ${KAFKA_BOOTSTRAP_SERVERS:dev-dtm-one05.ru-central1.internal:9092}

Параметры конфигурации:

KAFKA_BOOTSTRAP_SERVERS - URL-адрес для доступа к Apache Kafka (ProStore).

2.2.4.2.2. Секция http

Секция http предназначена для настройки порта и протокола передачи данных (одно из значений http или https).

Например:

http:

port: ${HTTP_PORT:8080}

enabled: ${HTTP_ENABLED:true}

Параметры конфигурации

port- порт для старта веб-сервера;enabled- статус включения/отключения веб-сервера.

2.2.4.2.3. Секция query-executor

Секция query-executor определяет настройки настройка получения входящих запросов.

Например:

query-executor:

reader-pool-size: ${READER_POOL_SIZE:20}

rest-pool-size: ${REST_POOL_SIZE:5}

writer-pool-size: ${WRITER_POOL_SIZE:1}

kafka-pool-size: ${KAFKA_POOL_SIZE:20}

Параметры конфигурации

reader-pool-size- размер пула на чтение, например:READER_POOL_SIZE:20;rest-pool-size- размер пула на REST, например:REST_POOL_SIZE:5;writer-pool-size- размер пула на запись, например:WRITER_POOL_SIZE:1;kafka-pool-size- размер kafka пула на отправку, напримерKAFKA_POOL_SIZE:20.

2.2.4.2.4. Секция send

Секция send определяет настройки отправки файлов.

Например:

send:

chunk-row-count: ${CHUNK_ROW_COUNT:1000}

file-buffer-size: ${FILE_BUFFER_SIZE:1048576}

read-job-count: ${READ_JOB_COUNT:4}

serialize-channel-size: ${SERIALIZE_CHANNEL_SIZE:20}

serialize-job-count: ${SERIALIZE_JOB_COUNT:4}

send-channel-size: ${SEND_CHANNEL_SIZE:20}

send-job-count: ${SEND_JOB_COUNT:4}

file-size-restriction: ${SEND_FILE_SIZE_RESTRICTION:1024}

Параметры конфигурации:

chunk-row-count- размер отправляемой порции данных, напримерCHUNK_ROW_COUNT:100;file-buffer-size- размер буфера на чтение файла, напримерFILE_BUFFER_SIZE:1048576;read-job-count- количество Job на чтение, напримерREAD_JOB_COUNT:4;serialize-channel-size- размерChannelдля сериализации, напримерSERIALIZE_CHANNEL_SIZE:20;serialize-job-count- количество задач на сериализацию, напримерSERIALIZE_JOB_COUNT:4;send-channel-size- размер задач на отправку, напримерSEND_CHANNEL_SIZE:20;send-job-count- количество задач на отправку, напримерSEND_JOB_COUNT:4;file-size-restriction- ограничение на размер оправляемого файла (мегабайты), напримерSEND_FILE_SIZE_RESTRICTION:1024.

2.2.4.2.5. Секция logging.level

Секция logging.level определяет настройки записи логирования.

Например:

logging.level:

root: info

ru.itone: debug

2.2.4.2.6. Секция environment